NTSB(National Transportation Safety Board、米国家運輸安全委員会)は、2018年1月にTesla(テスラ)のModel Sが、米国カリフォルニア南部の高速道路に駐車していた消防車に衝突した原因を、米国時間9月4日に明らかにした。運転者の不注意、先進的ドライバー支援システムAutopilot(オートパイロット)の設計、そうした機能への過信といった要因の組み合わせによるものという。

NTSBは、事故に関する重要な詳細を示した暫定的な概要を発行した翌日に、衝突の推定原因に関するブリーフィングを提出した。そこには、消防車に衝突した際に、Model SはAutopilotモードに入っていたことが記されている。

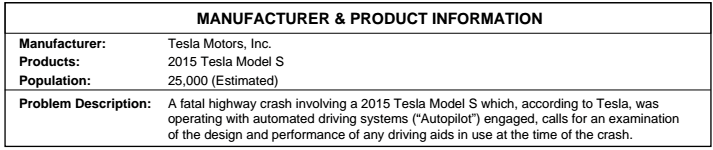

2014年式のTesla Model Sによる衝突事故は、2014年1月22日にカリフォルニア州カルバーシティで発生した。州間ハイウェイ405の上に駐車していた消防車に衝突するまでのほぼ14分間にわたって、そのTeslaではAutopilotが作動していた。運転者は、その事故で負傷しなかった。また消防車には人が乗っていなかった。

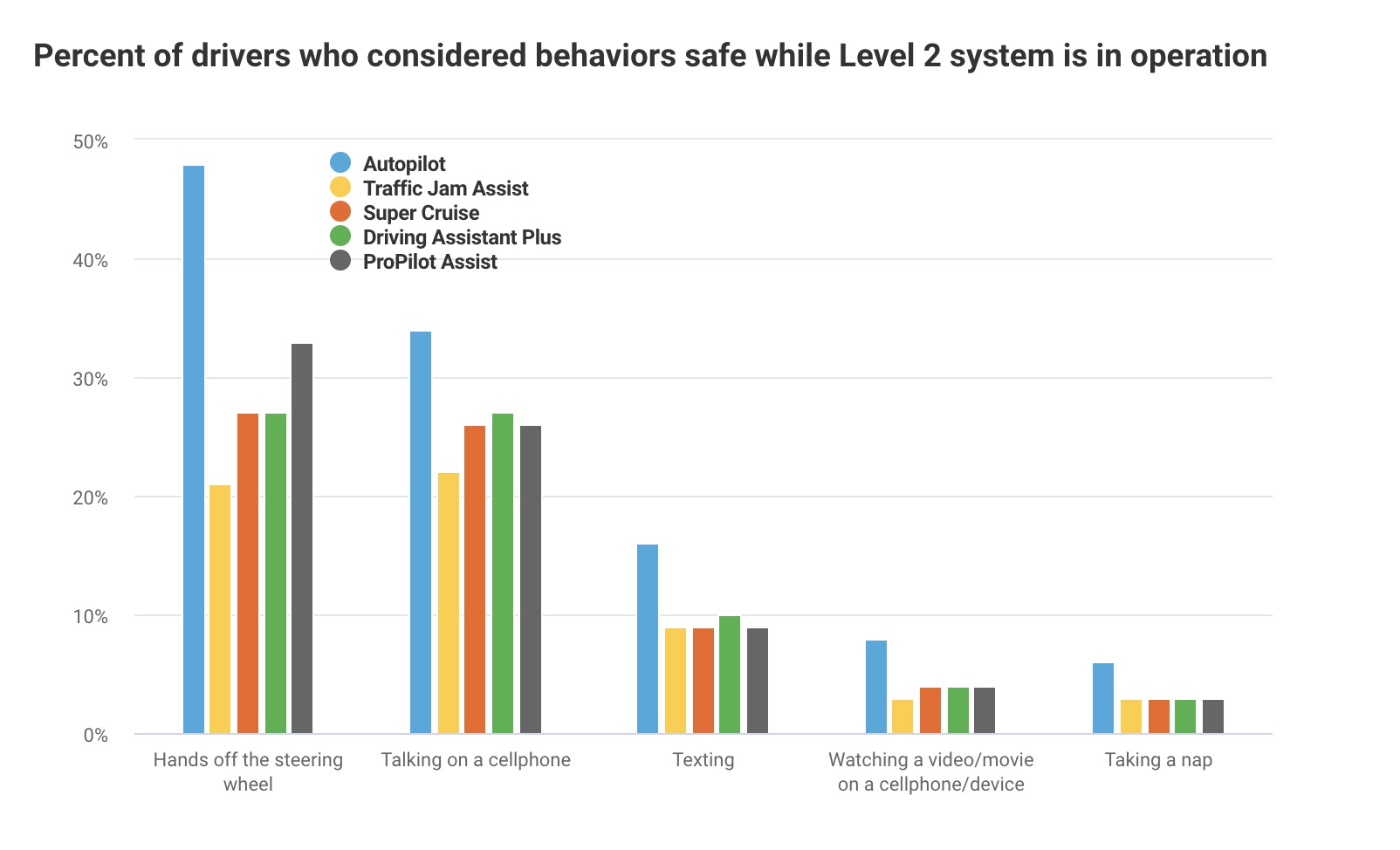

Tesla Model Sのオーナーズマニュアルには、こうした機能の制限事項とともに、運転者がハンドルを握り続けることの必要性について、多くの警告が記載されている。しかし運転者は、そうしたことに注意を払っていないのだと、NTSBは言う。さらに重要なことは、TeslaのAutopilotの設計は、運転者が運転操作を放棄することを許していると、NTSBは結論付けている。

NTSBによると、Autopilotは、衝突直前の13分48秒の間作動していた。その間、運転者がハンドルにトルクをかけていたのは、わずか51秒間だけだったと、システムが検出していた。また衝突した車両は、「ハードウェア1」というバージョンであったことにも注意する必要があるという。Model Sの「ハードウェア2」バージョンは、2016年に生産が始まり、より信頼性の高いセンサー類を装備している。

Teslaは、報告書に回答して以下のように述べている。これまでにTesla車のオーナーは、Autopilotを有効にした状態で延べ何十億マイルも走っている。同社の四半期ごとの車両安全性レポート(Vehicle Safety Report)のデータによれば、Autopilotを利用する運転者の方が、そのようなアシスタント機能を利用しない人に比べて、より安全であることが示されている、というのだ。

その衝突事故以降、TeslaはAutopilotシステムに改良を加えてきた。手放し運転に対する警告の時間間隔や、作動可能な条件などを調整したと、同社の広報担当者は声明で述べている。

Autopilotには、2つの重要な機能が含まれている。Autosteer(自動操舵)とTraffic-Aware Cruise Control(交通量感知型クルーズコントロール)だ。自動操舵は、同じ車線を維持して走行することを支援するシステムであり、交通量感知型クルーズコントロールが作動してからでなければ機能しないようになっている。交通量感知型クルーズコントロールは、カメラとレーダーからの情報に基づいて、速度を自動調整する。

衝突の詳細

NTSBによると、そのModel SではAutopilotが作動中であり、相乗り専用レーンを他の車の後ろについて走っていた。衝突の15秒前に、Autopilotシステムは、先行する2台の車を検出して追走を始めた。データによると、衝突の3〜4秒前に、先行車が右に車線を変更したと、NTSBのレポートは述べている。交通量感知型クルーズコントロールは、先行車を検出しなくなったため、Teslaを約21mph(約34km/h)から、クルーズコントロールにセットされていた80mph(約129km/h)まで加速しようとした。この値は、衝突の約5分前に、運転者によって設定されていた。

Autopilotシステムは、Teslaの進行方向に静止している物体を衝突の約0.49秒前に検出し、衝突および衝突予告警告が発動した。これは、視覚および聴覚に訴える警報を発するもの。衝撃の瞬間には、Teslaは30.9mph(49.7km/h)にまで加速していた。

[原文へ]

(翻訳:Fumihiko Shibata)