航空機に鳥がぶつかるバードストライクはそう頻繁ではないが、空港が注意を喚起しないほどに稀というわけでもない。しかし、鳥を近づけない、というのは難しい。何十、何百羽もの鳥の群の動きをどうやったらコントロールできるだろうか。もしかすると、CalTech(カリフォルニア工科大学)が考案した手法のような自律飛行ドローンが最善の策かもしれない。

現状では、人がマニュアル操作するドローンを活用している空港もあるが、それはコストがかかり、またそうした技術を持つパイロットの数はそう多くない。それとは別に、調教したハヤブサを使うという手もあるが、こちらも大規模展開するのは無理がある。

CalTechのSoon-Jo Chungは、2009年にUSエアウェイズ1549便がバードストライクに遭って墜落しそうになりつつもなんとかハドソン川に不時着したという、大惨事となりかねなかった事件後にこの分野に興味を持った。

「ハドソン川の一件を見て、次はハッピーエンディングにはならないだろうと思った」とCalTechのニュースリリースで述べている。「だから、私は自分の研究分野であるオートノミーとロボティックスを使って鳥から航空機を守る方策の検討を始めた」。

ドローンは、明快な策と思われる。空中に放ち、ガンの群を追いやる。しかし鳥の動きを予測し、群の行動に影響を与えるのは、そんなに簡単なことではない。

「ドローンをどの位置につけるかについては、細心の注意を払わなければならない。あまりにも遠すぎると、群を動かすことはできない。また、近すぎると、群をバラバラにしてしまい、本当にコントロールできなくしてしまう」とChungは話す。

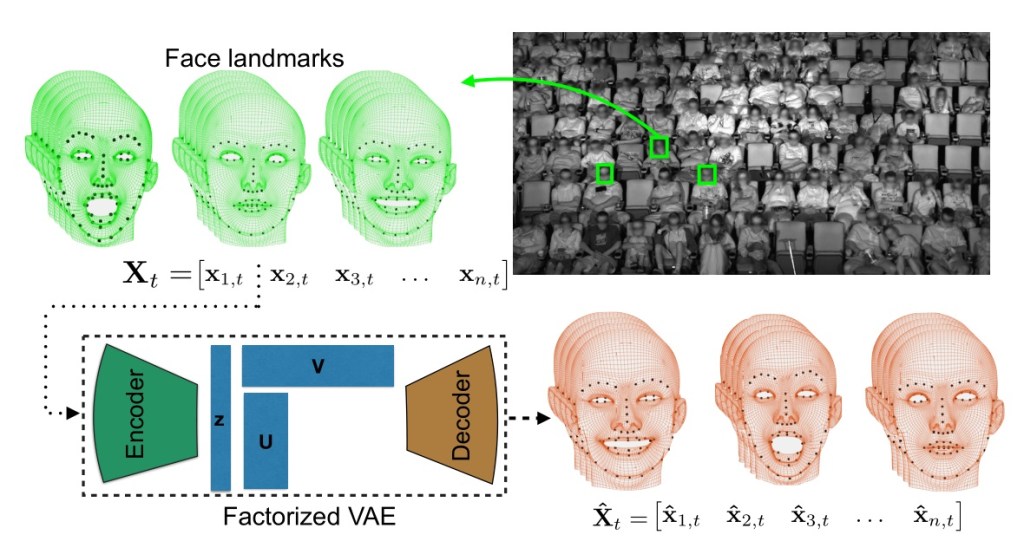

研究チームは、動物の群がいかに動き、互いにどう影響し合っているのかモデル研究を行なった。そして、鳥の群れが脅威となるものに対しどう動くのかを示すモデルを作りあげた。このモデルから、鳥をパニックに陥らせたりバラバラにしたりすることなく、好ましい方向に追いやれるようなドローンの飛行経路を導き出した。

研究チームは、新ソフトウェアを搭載したドローンを数カ所で試し、特定エリアに鳥が入らないよう指示して飛ばした。下記にあるように(こちらのビデオからの抜粋だ)、効果があるように見える。

当然、あらゆる規模の群れやスピードなどにも安定して対応できるシステムにするためには、まだ実験を重ねる必要がある。とはいえ、このシステムが航空機をバードストライクから保護するスタンダードシステムになるのは想像に難くない。正確なレーダーを使った1ダース前後のドローンで広範囲をカバーすることができるかもしれない。

研究結果は IEEE Transactions on Roboticsに掲載された。

イメージクレジット: Peter Linehan / Flickr under a CC BY 2.0 license.

[原文へ]

(翻訳:Mizoguchi)