数週間前にCESでGoogleは、Androidでウェブページ全体を読み上げられるようにする機能をデモしてみせた。指定した記事を全部を読み上げてくれるので読みたいが手がふさがっていてスクロールできないときやスマホの画面をずっと見ていたくないとき、運転中などに理想的だ。Androidデバイスに 「OK, Google, read this page」(このページを読んで)と命ずると、Googleアシスタントのニューラルネットワークが起動し、即座に読み上げてくれる。

ページまるごと読み上げ機能は米国時間3月4日、Androidの全ユーザーに公開された。

注目点

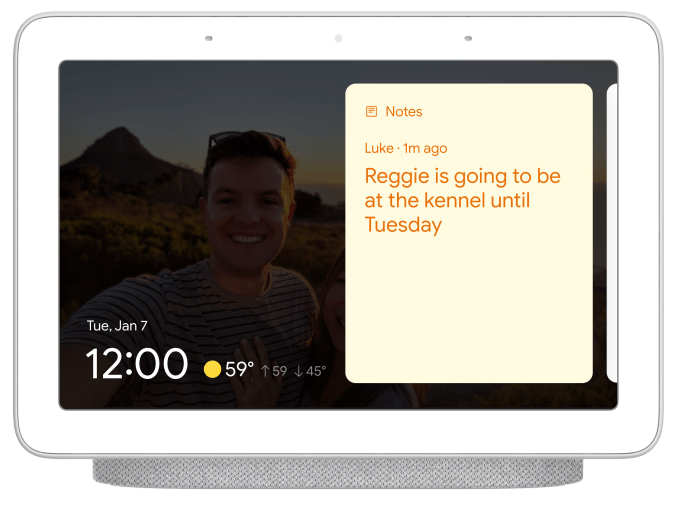

- 読み上げているテキストが強調表示され、ページが自動スクロールされる。記事のどこを読み上げているのかがひと目で分かる。以前Googleはこういう機能を追加する可能性があると言っていたが一般公開の時期などは不明だった。さいわい準備が整ったようだ。

- 読み上げ速度を調整できる。ポッドキャストを3倍速で聴きたいといったせっかちな人間には便利な機能だろう。

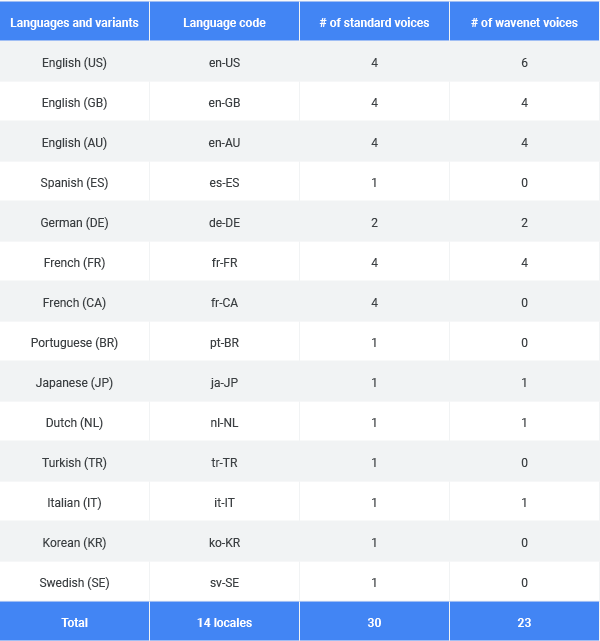

- 翻訳機能もある。Googleアシスタントのデフォルト以外の言語を読み上げさせようとする場合、ユーザーが選択した40以上の言語に翻訳が可能。

- ページの管理者はGoogleアシスタントが読み上げないよう設定できる。なんらかの理由でGoogleアシスタントに音声でページを読み上げられたくない場合(個人情報などが含まれていて、読み上げ機能が誤って起動されると困るような場合)、HTMLメタタグで無効化できる。これはページ単位で設定しておく必要がある。

Googleによれば近年公開されたAndroid(Android 5、Lollipop以降)が作動するほとんどのスマートフォンで利用可能だという。

【Japan編集部追記】速度調整は読み上げ画面の下部をタップする。0.5倍から3倍まで調整できる。現在の訳者の環境(Android 10)では「OK, Google, read this page」でTechCrunch Japanの記事を日本語で読み上げたが、日本語で「OK Google、このページを読んで」では読み上げは実行されなかった。

[原文へ]

(翻訳:滑川海彦@Facebook)

Sonos(ソノス)は、ユーザーの手持ちのステレオやAV機器に接続して使える新製品を発表した。アップルのAirPlay 2の機能を、アンプを通して既存のスピーカーシステムで利用できる。それが399ドル(約4万2700円)のSonos Portだ。これまでにもSonosシリーズにあったSonos Connectと同様の機能だが、仕様を一新し、かなり小さなボディで実現した。

Sonos(ソノス)は、ユーザーの手持ちのステレオやAV機器に接続して使える新製品を発表した。アップルのAirPlay 2の機能を、アンプを通して既存のスピーカーシステムで利用できる。それが399ドル(約4万2700円)のSonos Portだ。これまでにもSonosシリーズにあったSonos Connectと同様の機能だが、仕様を一新し、かなり小さなボディで実現した。