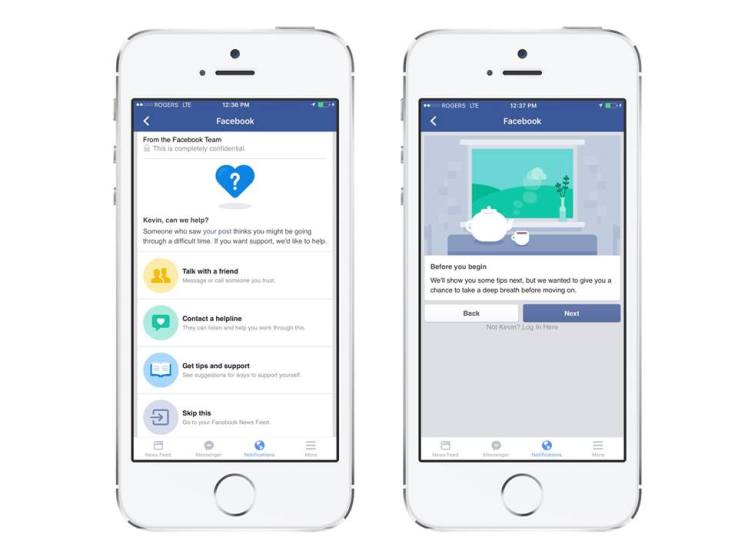

意見を交わすためのウェブサイトで、何千ものコミュニティを擁するRedditは今週、メンタルヘルスサービスのCrisis Text Lineと新たに提携したことを発表した。Crisis Text Lineは自殺を考えている人や自傷する人など、精神的に追い詰められている人を年中いつでもサポートするメンタルヘルスのためのテキストラインだ。今回の提携で、Redditユーザーは誰かの投稿に悩みや危機感がにじんでいるのに気づいたら、その人にフラグを立てることができる。するとフラグが立てられたユーザーにはリソースやカウンセラーにつながるヘルプラインを紹介するプライベートメッセージが送られる。

昔のヘルプラインは電話をしなければならなかったが、Crisis Text Lineではテキストでやりとりする。スマートフォンとともに育った世代、あるいは電話に対して恐怖感を持つ人に好まれるコミュニケーション手法だ。

利用には、番号741741に「CHAT」という文言をテキストを送る。すると、必要なだけカウンセラーとテキストでやりとりできるようになる。カウンセラーはその人が気持ちや考えを落ち着かせるのを手伝ったりするほか、質問をしたり、共感を示したり、話を積極的に聞いたりする。

フラグを立てた人も、そうした行動が引き金になりえることから同じサービスを通じてサポートを受けられる。

投稿やコメントを報告するには、「誰かが自殺や深刻な自傷を考えています」というオプションを投稿から直接選択できるようになっている。また、直接相手のプロフィールにいき、「彼らを手助けし、サポートする」を選ぶこともできる(Webではこの機能は「追加のオプション」内にある)。

投稿やコメントを報告するには、「誰かが自殺や深刻な自傷を考えています」というオプションを投稿から直接選択できるようになっている。また、直接相手のプロフィールにいき、「彼らを手助けし、サポートする」を選ぶこともできる(Webではこの機能は「追加のオプション」内にある)。

Redditはまた、たとえ多くの人がフラグを立てて投稿をレポートした場合でも、つらく厳しい状態に置かれて人が立て続けにメッセージを受け取ることがないようにする、ともしている。「エラーでメッセージを受信」を報告するリンクもあり、Redditはこの機能の乱用もモニターできる。

Crisis Text Lineは、これまで全ケースの30%のみが自殺についてのものだ、という。カウンセリングが状況を段階的に落ち着かせることができているため、「積極的な救助」は会話の0.82%をにすぎないとのことだ(積極的な救助では、対象者の電話番号が911に提供される)。また、そうした状況にならない限り、カウンセラーは相手の電話番号を知ることもなければ、電話をかけることもない(電話番号は暗号化されている)。

Redditは、自社のプラットフォームが頻繁にサポートに利用されていることからCrisis Text Lineとの提携を決めた。今日では、Redditユーザーが難題に直面した時に助けを求められる数多くのフォーラムを提供する。例えば喫煙や禁酒、妊娠、不安・鬱の解消などについてだ。また、 r/KindVoiceやr/CasualConversationなど話し相手を見つけることだけに特化したコミュニティもある、とRedditは話す。

「Redditでは、自分に関係する無数のトピックについてのコミュニティを探すことができる。匿名のプラットフォームとして、自身の最も弱い部分をさらけだすためのスペースを人々に提供する」とRedditは発表文で述べている。

もちろん、こうしたコミュニティを主催するのであれば、Redditはユーザーに対し、安全とレポート機能を確保する責務を負う。

「ユーザーが安心感や24時間いつでもコミュニティにサポートされていることを感じられるRedditとの提携をうれしく思う」とCrisis Text Lineの共同創業者でチーフデータサイエンティストのBob Filbin(ボブ・フィルビン)氏はいう。「ユーザーがいつでも信頼できるメンタルヘルスリソースにアクセスできるようにすることで、Redditはオンラインセーフティ分野で思慮深いリーダーであることを証明した」

[原文へ]

(翻訳:Mizoguchi)