その昔、人びとは目から放たれた見えない光線が世界を照らし、それが見るものへの視覚をもたらしているのだと考えていた。もちろん、それは間違いだったのだが、だからといってそれが「見る」ための完璧な方法ではないということではない。実際、それこそがライダーの基本アイデアなのだ。ライダーは、今や考古学から自動運転車に至るまでその有用性が証明されたデジタルイメージ手法である。

ライダー(Lidar)は頭字語の1種で、通常は「light detection and ranging(光による検知と測距)」の略語とされる。まあ最初の2語の間に「imaging」を差し込みたい人もいるだろうけれど。ソナーやレーダーと響きが似ているのは偶然ではない、それらは皆同じ原理である「反響定位法(echo location)を採用しているのだ。まあ、コウモリにできるのだから、私たちにできない理由はないだろう。

エコーで見る

基本的な考え方は単純だ。何かを世界に発射し、それが戻ってくるまでにどれ位の時間がかかっているのかを追跡する。コウモリは音波を使っている。短いきしみ音が環境で反射して、木や虫がどれくらい離れているかによって、耳に戻ってくる時間が異なってくる。それをソナーに転用するには少しばかりの想像力が必要だ、それはより大きな音声パルスを周りの水に向けて発射し、エコーを聞く。もし音波が水中を進む速度を正確に知っていたなら、そして音波が何かに反射して戻ってくる迄にどれくらいかかるかを正確に計測できるなら、反射したものが何であれ、そこまでの正確な距離を知ることが可能だ。

そこからレーダーへの進化はそれほど大きなものではない、ほとんど同じようなことを電波を使って行うのだ。私たちが、飛行場や大きな船の上で、くるくる回るのを見るレーダーアンテナは、電波のビームを発射しているのだ。そして電波は固体に(特に飛行機のような金属に)当たると反射して、それがレーダーアンテナによって検出される。そして私たちは大気中の光の正確な速度を知っているので、飛行機までの距離を計算することができる。

さて、電波は長い距離に渡って固体をみつけるためには大変素晴らしいものなのだが、幾つかの欠点も存在する。例えば、電波はいくつかの物質は反射せずに通り抜けてしまうし、物理学が関係してくるのだが、100フィート(約30.5メートル)程度以下の距離では扱いが難しいのだ。一方、音波には反対の問題がある。それは急速に減衰し速度も相対的に遅い。このため十数フィート以上離れているものを見つけるためには不向きなのだ。

ライダーは有利な点の多い技術だ。ライダーシステムは、レーザーを使って可視スペクトル外の光のパルスを発射し、そのパルスが戻ってくる時間を計測している。ある特定のパルスが反射した方向と距離を、ライダーユニットを中心とした大きな3D地図の中の点として記録する。異なるライダーユニットは、異なる手法を用いるが、一般的にはレーダーアンテナのように円形のスイープを行いながら、同時にレーザーを上下させている。

ライダーが最初に提案された1960年代は、レーザーならびに検出メカニズムは、かさばる上に動作も遅かった。今日では、小さくなった電子部品と高速なコンピューターのおかげで、ライダーユニットは1秒あたり100万回を超えるパルスの送受信が可能であり、1秒あたり何百回もの周囲検知を行うことが可能だ。

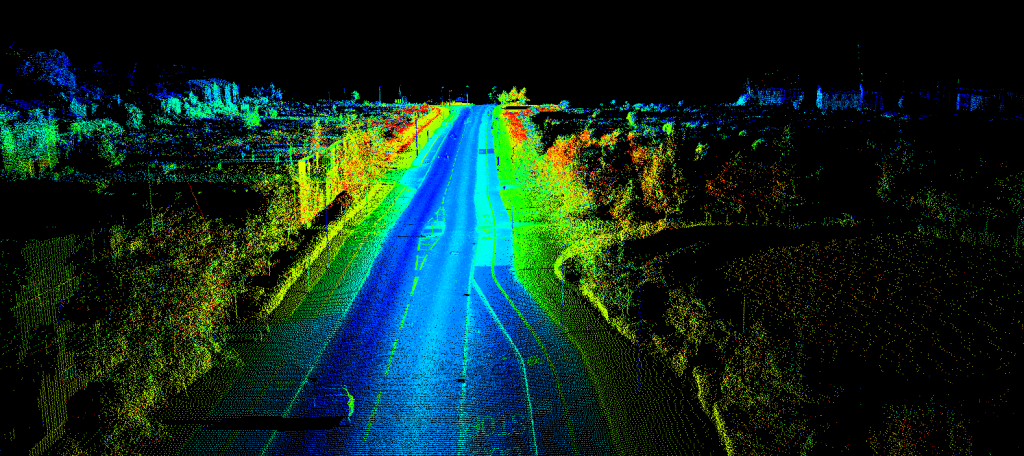

戻ってくるレーザパルスからの座標の集合である「ポイントクラウド」は、驚くほど精細で(そして美しい)、環境とその中のオブジェクト全ての輪郭を描き出すことが可能だ。

飛行機やヘリコプターのライダーユニットは、飛行中迅速かつ正確に、地上の地形を調査することができる。また考古学者は、ライダーユニットを送り込むことで、その場所の詳細を1インチ単位で記録することができる。また最近では、自動運転車やロボットに搭載されたコンピュータービジョンシステムが、その周囲の状況を簡単に把握することができるようになった。

飛行機やヘリコプターのライダーユニットは、飛行中迅速かつ正確に、地上の地形を調査することができる。また考古学者は、ライダーユニットを送り込むことで、その場所の詳細を1インチ単位で記録することができる。また最近では、自動運転車やロボットに搭載されたコンピュータービジョンシステムが、その周囲の状況を簡単に把握することができるようになった。

路上の目

ライダーが手に入れた役立つ用途は、特に最後のものによく適応している。すなわち日常世界のナビゲートだ。私たち人間は、私たちの両眼の視覚から得られる僅かに離れた画像を使って、距離を抽出する洗練された手段を持っている。しかし、もし私たち自身の目からレーザーを発射できて、その反射時間をナノ秒レベルで感知することができるなら、更に素晴らしいことだろう。

ライダーユニットは、一般的には筒状の小さな突起物である。その中ではレーザーと検出器が回転している。多くの自動運転車やプロトタイプの上についているのを見たことがあるだろう。それらは実用上十分に詳細な3Dイメージを生成するので、自動車の電子頭脳に組み込まれたコンピュータービジョンシステムは、車とトラック、自転車とオートバイ、そして大人と子供さえ区別することが可能だ。これは重要なことだ。そうしたものはみな異なる振舞を示し、車の減速を促したり、側方に隙間を空ける必要を生じるかもしれないからだ。

ここに示したビデオはやや古いものだが、車がライダーシステムで周りの何を見ているかについて、分かりやすいイメージを与えてくれる。

とはいえライダーが全てを行うわけではない。例えば、それは標識の文字は平たいので読み取ることができない。そして、もし可視性が限られている場合には、比較的容易にシステムは混乱する。豪雪、濃霧、その他ユニットの視界を妨げるものに影響を受けるのだ。よって、ライダーは他のシステムと連携して動作する必要がある。そのいとこであるレーダーやソナー(実際には超音波)、そして通常の可視光カメラも同時に利用する。ライダー自身は「バンプ(凸あり)」の標識サインを読み取ることはができないかもしれないが、可視光カメラは実際のバンプに直前まで気が付かないかもしれない。チームとして働くことで、システムは間違いなく周囲の環境に対して、人間よりも優れた意識を持つことができるようになるのだ。

高速で高精度のコンピューター知覚の世界は、複雑で急速に進化している。よってライダーの役割も、他のテクノロジーによって追越されたり、その性能を向上させられたりすることによって変わっていくだろう。しかし紀元前500年には否定された視覚の概念が、いままた脚光を浴びているのは間違いないようだ。

[ 原文へ ]

(翻訳:Sako)