今やGPUは、Crysisを高いフレームレートでプレイするためにある、という時代ではない。何らかの大規模な変換処理を行うコンピューティング技術の多くが、今ではGPUを使って並列処理の高速化を図っている。

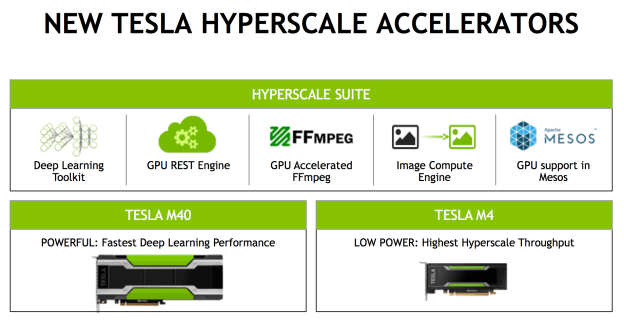

ビデオのエンコーディングはその典型的な例だが、最近では機械学習もそのひとつだ。NVIDIAはとくに後者に力を入れており、今日(米国時間11/10)は新しいハードウェアアクセラレータ二種と、デベロッパやデータセンターの管理者がこれらのアクセラレータを深層学習とその上での画像/ビデオ処理に利用するための、一連のツールを発表した。

さらにNVIDIAは今日、Mesosphereとのパートナーシップを発表した。Mesosphereは、大規模なデータセンターをあたかも単一のリソースプールのように管理できる、コンテナベースのツールで、NVIDIAとの提携により、“Webサービスの企業がアクセラレータを導入したデータセンターを構築およびデプロイし、次世代のアプリケーションに備えられるようにする”、としている。

MesosphereとNVIDIAの提携は、データセンターのオペレーティングシステムを自称するMesosphereを介してApache Mesosを使用するデベロッパにとって、データセンターでCPUやメモリ等のリソースと同列にGPUも利用できることを意味する。コンピューティングリソースとしてのGPUが単一のプールへとクラスタ化され、ソフトウェアが複数のジョブを、その互換GPUが動くさまざまなマシンへと自動的に分散化する。

NVIDIAが今日発表した二つのハードウェア製品、M40とM4 GPUアクセラレータは、とくにM40が機械学習向けに最適化され、データセンターでの使用をテストされている。M4も同様に最適化されているが、消費電力の低いビデオ処理などに向いている。

今ではAWSやMicrosoft(Azure)など、多くのクラウドベンダがGPUをメインに使った仮想マシン*を提供、または近く提供の予定だ。ほとんどの場合、使用しているのはNVIDIAのGPUである。Googleは社内的には機械学習を大々的に展開しているが、一般ユーザ向けのクラウドプラットホームにはGPUメインのインスタンスがない。でもおそらく、Google独自の機械学習サービスの提供開始と並行してGPUインスタンスも提供されるのではないか、と思われる。〔*: 日本語ページ。〕