本物らしい良質な合成音声を作ることは今、ホットな研究開発テーマだが、一歩リードしているのはGoogleだろう。同社は今日、Tacotron 2なるものを発表して、さらにその差を広げたかもしれない。これは人工知能にテキストを読ませてリアルな音声を作り出すための、ニューラルネットワークの新しい訓練方法で、ユーザーには文法知識がなくてもよい。

この新しいテクニックは、Googleのこれまでの音声生成プロジェクトWaveNetと初代Tacotronの良いとこ取りをしている。

WaveNetは、ぼくの感想では“気味が悪いほど本物そっくりの”音声を作り出し、しかも一度に一つずつのオーディオサンプルを作るので、あまり実用向きではない。WaveNetは有能ではあるけど、最初に言語に関する大量のメタデータを必要とする。発音や、言語のさまざまな特徴などだ。

初代Tacotronは、イントネーション(抑揚)や強弱などを含む、より高いレベルの音声合成ができるが、実用的な最終製品を作るのには向いていない。

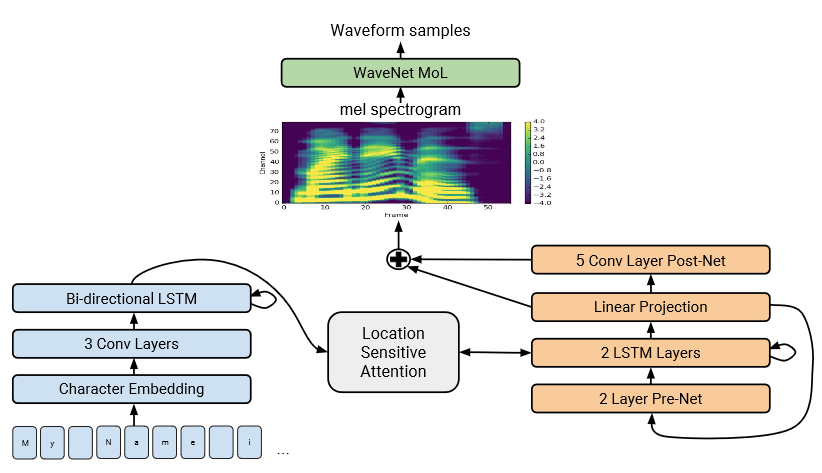

Tacotron 2は、この両者を利用している。ぼくはこの方面の技術には疎い方だけど、理解できる範囲で言えば、このシステムは、言葉のルールを明示的に教えなくても、テキストの原文とナレーションからそれらのルールを予測推定する。テキスト本体は、Tacotronがリズムや強調を得るために使う“メル尺度スペクトログラム(mel-scale spectrogram)”に変換され、語そのものはWaveNet的なシステムを使って生成される。

そうやって得られた音声は、ここにサンプルがあるが、今世の中にあるものの中では最良ではないだろうか。語りのリズムは自然だが、ちょっと快活すぎるかもしれない。わかりにくい発音のある語ではつまずくが、それらは主に、アメリカ英語に外から輸入された語、たとえば“decorum”をこのシステムは第一音節を強調するし、フランスのワイン用ぶどうの品種“Merlot”は書かれた綴りをそのまま発音するので笑わせる。研究者たちは、“極端なケースでは奇妙なノイズをランダムに生成することもある”、と書いている。

また、音声の口調…元気である、心配しているなど…をコントロールすることはまだできない。アクセントなどは、WaveNetでできたように、できる。

訓練システムの敷居を下げれば、もっと良質な訓練ができるだろう。Googleのこの新しい方式では言葉や話法に関する複雑なルールを、言語や音声スタイルが変わるたびに手作業で教えなくてもよい(ニューラルネットワークを実例で訓練するだけだ)。

研究者たちは結果をIEEEのカンファレンスInternational Conference on Acoustics, Speech and Signal Processingで発表する予定だが、そのためのペーパーはarXivで読める。