2011年にSiriがiOSに登場してから、聞けば何でも答えてくれるデジタルアシスタントは大手スマートフォンプラットホームの共通の大課題になってきた。

AppleがそのAIコンパニオン(Siri)を出してから1年も経たないのに、GoogleはGoogle Nowでそれに続いた。それは、ユーザの位置やメールの受信箱やそれまでのトラフィックの履歴などに基づいて、前もっていろんな通知をくれるサービスだ。

そして今年はMicrosoftが同社のBuildカンファレンスで、スマートアシスタントCortanaを発表した。その名前は、HaloゲームのXbox上のフランチャイズに登場するAIの名前を借りている。Microsoftによると、Cortanaはまるでユーザの秘書のように、あるいはこれから帰宅するとき妻にあれこれ用事を電話するどこかの旦那のように、忘れてはならないことを間に合うタイミングで事前に思い出させてくれるAIサービスだ。

彼らは今日のフライトに間に合うためにはいつもより15分早く退社しろ、と教えてくれるお利口さんだし、SiriやCortanaはときどきジョークも言うが、これらのアシスタントたちには明らかに限界がある。Siriはリマインダーだが、ユーザ自身による会議のスケジューリングを助けてくれない。Google Nowは近くのレストランを教えてくれるが、ユーザの好きな席のテーブルを予約できない。

Fancy HandsやJarvisのような、有料のデジタルアシスタントもある。毎月の料金を払うと、これらのサービスは、SiriやCortanaを出来損ないアプリのアルファバージョンかと思わせるほど、見事にユーザのリクエストに応える。

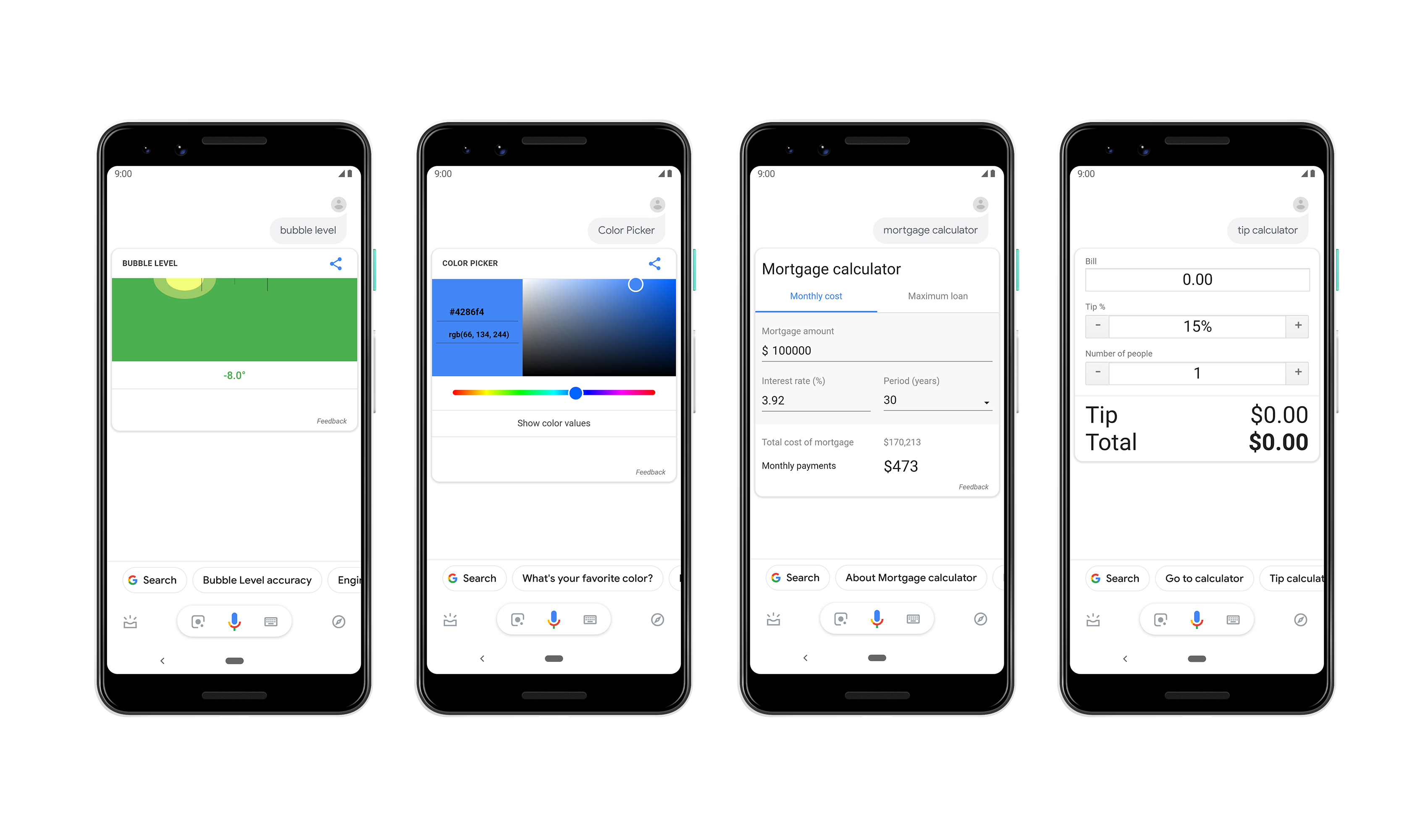

〔ここにスライドが表示されないときは、原文を見てください。〕

これらのアシスタントは、どうやってこれほど高度な仕事をやっているのか? Jarvisはユーザが好きな食べ物を知っているのか? ユーザが乗れるフライトを探すときは、ユーザのスケジュールを秘かに見ているのか? 定型メールを送っているだけなのに、リアルな対話っぽいやりとりができるのか?

たしかにそうだが、でもそれは、彼らのAI技術が人知れず高度だからではない。彼らは、デジタルアシスタントのTaskRabbit(人力便利屋)を作ったのだ。リクエストを送るとその先には、学卒の労働者がコンピュータの端末の前に座っていて、ユーザのオフィスの近くにおいしい食べ物屋さんを探したり、価格比較サービスを利用してフライトを見つけたりしている。

今のWebアプリケーションがどんなに便利でも、仕事先の人を接待する店をYelpで探すのはかなりの手間だ。候補が多くてなかなか決められない人もいる。でも、これらの有料デジタルアシスタントのユーザたちに話を聞いてみると、そういうとき候補を三つか四つしか言わないので、決めやすいということだ。退屈で些細な仕事は誰かにやらせたい。ふつうの人たちにとって、その誰かが100%コンピュータのプログラムでなければならないことはない。

数年後には、これらのタスクもソフトウェアがやるようになるだろう。AppleもGoogleもMicrosoftも、現状の技術に納得してはいない。また、Siriの作者などが作った新しい企業は、ユーザの好きなアプリをすべて知ることにより、ユーザが抱える状況をある程度理解した上でアシストを提供するサービスを、提供しようとしている。

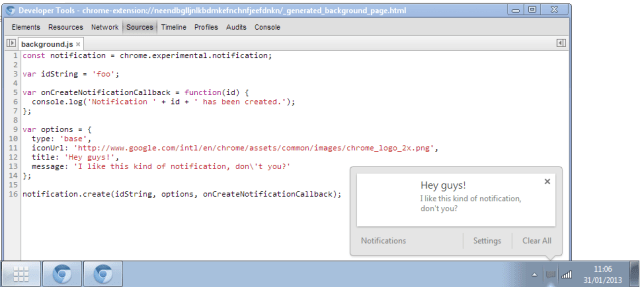

でもそれまでは、人間がまるで機械の中の歯車のように、これらのサービスにはめ込まれている、という面白い光景がある。ユーザにとってのインタフェイスは、人間というより、まるっきりアプリのそれだ。Jarvisはテキストメッセージングやメールを使うから、Siriのメッセージング機能からでも利用できる。データも、上の画像で見られるとおり、人の言葉というよりもコンピュータの出力だ。しかし複雑なコンテキストを解析したり、単純なリクエストからそのコンテキストを理解することは、コンピュータにとって何年も先の話だ。

でもそんなテクノロジがやってきたら、これらの人力サービスはなくなるのだろうか? それとも、そのときはまた、コンピュータには対応できない分野を見つけてサービスを続けるのか? たとえば、毎日忙しくてやるべきことが多すぎる人や、仕事の内容やニュアンスをコンピュータが得意とするシンプルで単純な言葉では表現できない職種の人は、相当進化したAIアシスタントにもやはり、不満を感じるかもしれない。コンピュータの前に座る人間労働者は、AIも道具として使いながら、今よりも多くの仕事をこなせるようになっている、のかもしれない。

[原文へ]

(翻訳:iwatani(a.k.a. hiwa))