最近、私はGoogleでストリートビューを創造したメンバーに長時間インタビューする機会があった。そこでこのプロジェクトがラリー・ペイジの夢想から始まって世界中の誰もが特に意識もせずに使う日常必須のツールへと成長したのか、そのプロセスを詳しく学ぶことができた。

ラリー・ペイジの車の屋根に積まれたかさばったカメラから始まったストリートビュー撮影システムはワゴン車、乗用車、三輪車、二輪車、はてはバックパック やスノーモビルにさえ搭載されている。2007年5月25日にスタートして以来、ストリートビューはGoogleが世界を観察する視覚となった。ときには賛否の議論 を巻き起こすこともあるが、Googleは前進を止めない。

ストリートビューのエンジニアリング・ディレクター、Luc Vincent とエンジニアリング・マネージャーDaniel Filip に会う前に、私はGoogleマップについてできるかぎり勉強していった。それでもストリートビューのコンセプトが生まれた当時、それがいかに「空に浮かんだパイ」のような夢物語だったかには気づかなかった。ストリートビューがこれほど身近になった今、多くの人々がこの誤解をしているものと思う。

そこに行く前のその場所の様子を知りたい

フランケンシュタインみたいな不気味な外見の車だった

Vincentによれば、ストリートビューの最初のコンセプトはスタンフォード大学のMarc Levoy の研究だという。 Levoyと彼の学生の一人がビデオを撮影してそれを1枚の画像に貼り合わせる技術を開発した。Googleはサンフランシスコ中の道路を撮影することができるかどうか見るためにこのプロジェクトに少額を投資した。その結果、ビデオの1コマずつを解析して非常に長大な街路の写真を合成することが可能だと判明した。写真は歪んでおり、画質は悪かったが、これがストリートビューの第一歩になった。

このテストの後、ラリー・ペイジは自分の車の屋根に巨大なカメラをくくりつけ、サンフランシスコ中の道路の写真を撮ってまわった。それらの写真をつぎはぎした巨大な画像はそのままでは役に立たなかったが、Vincentによれば、このテクノロジーはさらに興味深いものになった。

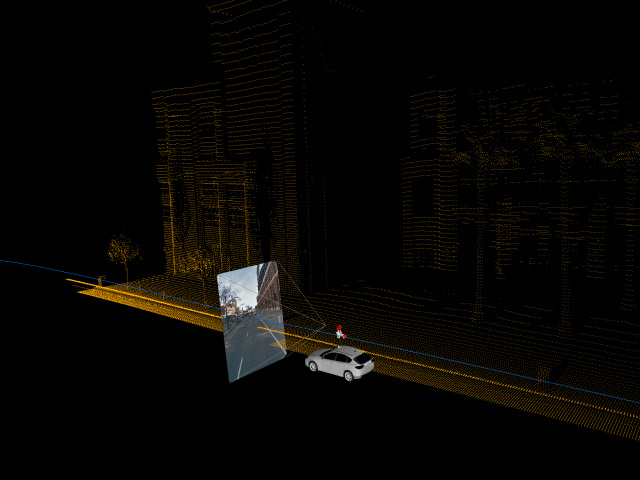

最初のストリートビュー開発チームは20%ルール〔社員は勤務時間の20%を自分の自由な実験に充てられるというGoogle独特の規則〕を使う少数の社員たちからなっていた。バンの屋根にはカメラとGPSとレーザーが搭載されていた。レーザーは建物など沿道の物体までの距離を測定するためだった。システムはこれによって3Dモデルを作り、画像を整合性を保って貼り合わせることができた。カメラはバンの車内のコンピュータ・アレイに接続され膨大な写真がその場で処理された。しかしまだまだ初歩的ななレベルだった。Vincentによれば―

フランケンシュタインみたいな不気味な外見の車だったが、われわれの目的に十分なくらいベイエリアの画像データを収集することができた。われわれは警備部門からバンを借りて街を乗り回した。しょっちゅうエラーが出て仕事が止まった。

正規のプロジェクトになる

しかし本格的にやるとものすごい費用が…

20%ルールで自分の好きなことをするのと、他人を巻き込み、正式なプロジェクトとして承認を受けるべく努力するのは全く別だ。Vincentのチームは十分なデータを集めてからそれを1つに継ぎ合わせてサービスとして意味のあるものに.した。

2005年の第3四半期にVincentのチームは金曜日の定例テクノロジー会議にストリートビューを持ちだした。ここで、エンジニアリング担当副社長を含めて、20%ルール以外の社員を充てることが承認された。2005年の10月にストリートビューは正式にGoogleの新プロジェクトに格上げされた。いよいよ後戻りはできなくなったわけだ。地球を隅から隅まで1ピクセルも余さずにデジタル画像化する途方もないプロジェクトが動き出した。対外的には秘密のままだったが、VincentはStreetViewプロジェクトに新規の人材を採用することができるようになった。Filipが最初の採用者だった。今でもこの2人がストリートビュー事業のリーダーだ。

2006の始め、ストリートビュー・チームのフルタイムのメンバーは7人だった。目的は実際に稼働するサービスを作り上げること。

この時期、われわれはいくつかの問題に取り組んでいた。ユーザー・インタフェースの専門家はチームに1人しかいなかった。見た目のとおりのパノラマ画像をユーザーが扱いやすい形で表現するのに非常に苦労した。というのはその当時、まだGoogleマップがなかったからだ。

意外に思う読者も多いだろうが、この時点では今われわれが見るようなGoogleマップは存在していなかった。ストリートビュー・チームはいわばGoogle自身と比べてさえ進みすぎていた。Vincentによれば、

われわれはまず新しいプラットフォームを作らねばならなかった。信頼性が高く、大規模に拡大可能でかつ車載可能なシステムでなければならなかった。われわれは8台のデジタル一眼レフを放射状の花びら形に配置した。完全な情報を得るためにシステムが高価になってもやむを得ないと覚悟していた。

データ処理

なんでもいいからできる限りの情報を集め、その後で使い方を考える

他のすべてのGoogleの活動と同様、ストリートビューでも収集したデータに対する膨大な処理が行われている。Googleはしばしばものに取り憑かれたようにあらゆるデータを収集しようとし、これがプライバシーに敏感な一部人々の反感を買っている。しかしGoogleは「なんでもいいからできる限りの情報を集め、その後で使い方を考え、人々の役に立てる」というアプローチを繰り返してきた。

ストリートビューで収集される情報量は膨大なものだ。Vincentのチームのバンは写真撮影の他に、GPS情報、周囲4箇所のレーザーによる対象物までの距離、風速、その他あらとあらゆる情報を記録した。

しかも現在ストリートビューのデータは全世界47カ国に散らばった3000のシステムから収集されている。

Vincentによれば、

ストリートビュー車には4、5台のコンピュータを積んだラックを装備してあったが、いつも何かが壊れた。われわれはこういうストリートビュー車を3、4台作って主にカリフォルニアでテストを繰り返した。始終不調になるので、なかなか規模を拡大することができなかった。

800万キロを走破した現在、不調が起きる確率は著しく減った。

データから意味を引き出す

われわれの両親の世代でも意味のある情報を簡単に引き出せるようにするためにストリートビュー・チームはありとあらゆる地理情報を処理できる部内用ツールを開発した。GPS、レーザー測距装置から得られたデータと写真を重ね合わせて、意味ある結果が得られるかを検討した。大量の試行錯誤の末に、ついに意味のある利用法にたどり着いた。

ストリートビュー・カーのドライバーは撮影済みデータを収めたハードディスクを5台ずつまとめてGoogleに送る。 それらはデータセンターで情報を吸いだされ、情報は中央データベースに格納される。

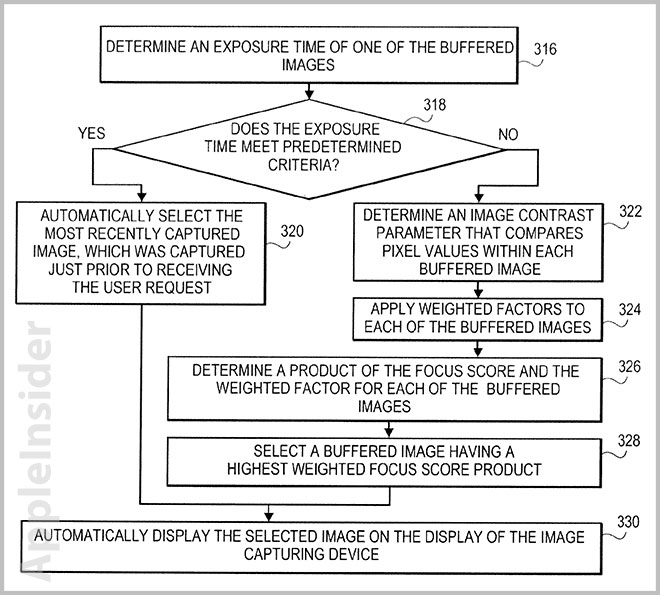

データセンターでの処理の1つは、人物の顔と車両のナンバープレートにモザイクをかけることだ。今となっては当たり前に思えるプライバシー上の配慮だが、ストリートビューが登場するまではこんなことは誰も思いつかなかった。そこでGoogleはこの作業が自動的に実行できるシステムを開発しなければならなかった。またストリートビュー・カーは同じ場所を15回撮影する。システムは15枚の写真を合成して露出、光線の反射、陰などを調整してできるだけ多くの情報が表示されるようにする。こうして完璧なパノラマ画像を用意するのだ。

同時にシステムは画像から道路標識などの情報を読み取り、Googleマップシステムに転送する。これも膨大な処理量となる。

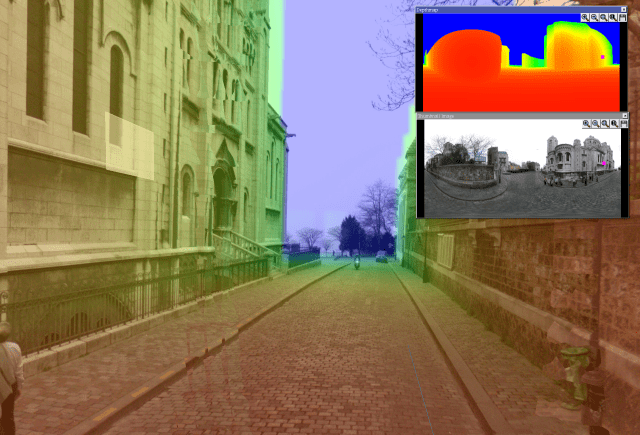

ストリートビュー車のそれぞれのカメラが写真を撮ると同時にその瞬間の位置情報とレーザー測距による空間情報も記録されている。これによってストリートビュー・チームはここに見られるような見事なパノラマ写真を合成することが可能になる。

水平方向を撮影するカメラと天頂を向いた魚眼レンズを装備したカメラによって沿道の建造物の3D画像が合成される。

この取材で知ったのだが、水平方向のカメラの視界が他の車両で遮られたときには他のアングルから撮影された写真で隠された部分を補うことができるシステムが用いられている。3D画像に撮影車自身が写らないのもこの技術によるものだ。

リリース、そして現在

トラフィックはあっという間にわれわれの処理能力を超えてしまった

2007年にストリートビューが公式にローンチされたとき、対象地域はサンフランシスコ、ニューヨーク、ラスベガス、マイアミ、デンバーだけだった。当時のカメラはそれぞれ5メガピクセルで、これは今の携帯のカメラ程度だ。現在用いられているカメラの解像度はなんと75メガピクセルだ。

ストリートビューはリリースと同時に大人気となったのだが、実はGoogleもストリートビュー・チームも公開前は果たしてユーザーにどのように受け止められるのかまったく予想がついていなかった。もちろんGoogleは公開に備えてそれなりにコンピュータの処理能力を用意はしていた。

〔ストリートビューの〕トラフィックは見ている前で天井まで跳ね上がった。そしてあっという間にわれわれの処理能力を超えてしまった。Googleで仕事をしていて良い点はそのサービスへのトラフィックと関心をリアルタイムでモニタできることだ。ストリートビューはローンチの直後からでとてつもない関心を集めていた。世界中のウェブサイトがストリートビューから引用した面白い写真を掲載し始めた。

ストリートビューのユーモラスな写真やショッキングな写真は以来、さまざまな議論を呼びつづけている。最近もストリートビュー車が野生のロバをはねたという非難 がいわれないものだと説明しなければならなかった。

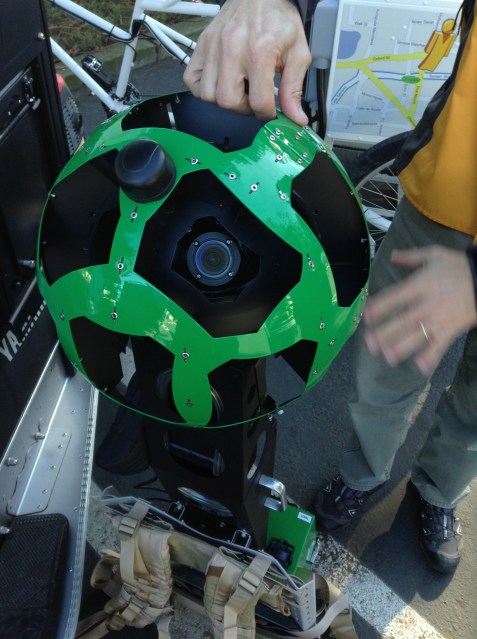

いずれにせよ初期型のバンは大量に製造するのに向かなかった。ここに写っているカメラはテントウムシ型で、水平方向の8台のカメラと天頂を向いた魚眼レンズ装着のカメラで構成されている。これを搭載した自動車が世界中を日夜走り回った。目にした読者も多いに違いない。

しかしこのストリートビュー・カメラが現在の形になるまでにはかなりの時間と努力が必要だった。Vincentによると、Googleが社内で利用する他のハードウェアの多くと同様、結局カメラもフレームもGoogleが独自に開発することになった。いちどテクノロジーのコア部分が完成すると、ストリートビューは小さな町や外国でも必要とされるようになったので、チームは二輪車にも搭載できるようにシステムのダウンサイジングを図った。有名なストリートビュー・トライク(人力三輪車)は自動車が入れない狭い路地や史跡の内部などを走り回っている。

2010年にバンクーバーで冬季五輪が開催されたとき、チームのメンバーの一人が山の景色をストリートビューに加えようと発案した。それはいいアイディアだということになって、カメラがスノーモービルに搭載された。気温がカメラには低すぎたのでエンジニアは自分のジャケットを脱いでカメラに被せなければならなかった。その後も次々に新しいアイディアが湧きでた。

われわれは人々を結びつけたかったのです

どうして屋外の写真ばかり撮っているのだ? 屋内のパノラマ写真もクールじゃないか? 特に有名な美術館、博物館の中は皆が見たいはずだ。そこでストリートビュー・カメラを載せたトロリーが開発された。屋内ストリートビューについてVincentはこう言う。

われわれは広い屋内空間を撮影するために小型のコンピュータシステムを開発し、すべてを手押し車に載せた。三脚では時間を食いすぎる。難しかったのは屋内ではGPS信号が受信できない点だった。そこでわれわれはGPSなしにトロリーの正確な位置を決定できるようレーザー位置測定に基づく複雑なアルゴリズムを開発しなければならなかった。このトロリーのおかげで現在50箇所の美術館、博物館の内部をストリートビューで見ることができる。

Vincentがストリートビュー・システムは十分な数の写真を撮影していない と感じるようになったため最新タイプのストリートビュー撮影システムには15台ものカメラが装備されている(魚眼レンズのカメラは必要がなくなった)。Googleは画像の質と正確性の限界を一歩先へ進める努力を常に続けている。Appleが地図サービスを独自にローンチしようとして大いに苦労している ことは記憶に新しいが、Googleはこうしたすべてを2005年から延々と続けてきたのだ。そればかりでなく、2007年以降、Googleの地図プロジェクトは信じられないほど巨大なスケールに拡大している。これに追いつくのは並大抵のことではあるまい。

インタビューの最後に、私はVincentに「そもそもなぜこんなことを始めようと考えたのか?」と尋ねてみた。彼大真面目な表情で答えた。「われわれは人々を結びつけたかったのです」〔Facebookのモットーとして有名)

複雑高度なものを日常ありふれたものに

Googleのテクノロジーのほとんどは舞台裏に隠れていてユーザーの目には触れない。ユーザーはソーセージがどうやって作られるかいちいち細かいことを知りたいとは思わない。気にするのはおしいかまずいかだけで、おいしければユーザーは戻ってくる。友だちにも勧めるだろう。VincentはGoogleのプロダクトが一般ユーザーにとって「当たり前のもの」になるのを好んでいる。そうなればイノベーションをさらに先へ進めることができるからだ。

将来、ストリートビューができそうなことは多い。バックパックで人が背負って歩けるトレッカー撮影装置は森や山で遭難した人々を捜索するのも応用 できる。すでにグランドキャニオンの壮大な景色 がいながらにして体験できるようになっている。

VIDEO

地図サービスでGoogleに追いつくためにはまずこうした高度に洗練されたハードウェアを今すぐ大量に配備する必要があるだろう。なにしろ現在も何千台ものこのカメラが世界中を撮影しつつあるのだ。

また関心のある場所の映像をスマートフォンでこれほどスムーズに閲覧できるのも驚くべきテクノロジーだということを忘れないほうがよい。もしかすると、そのうち読者もGoogleマップづくりに参加できるかもしれない。あのGoogle Glassのユーザーが目の前の光景を撮影してGoogleに送ると、それがストリートビューの一部になるかもしれない。

今はクレージーに聞こえるアイディアかもしれないが、なにしろ巨大なデジタルカメラを自分の車の屋根に積んで走り回るファウンダーのいる会社だ。どんなクレージーなことを始めるか予想もつかない。

[原文へ ]

(翻訳:滑川海彦 Facebook Google+ )