GoogleはこのほどMemorystore for Memcachedのベータ版を公開した。GoogleのMemorystoreサービスは高速性が必要とされる大規模データベースなどをクラウドのインメモリで作動させるのに適しているが、ここでMemcachedがフルマネージドで利用できるようになった。これは複数サーバのメモリを統合して利用するためのオープンソースのプロトコルで、2018年にGoogleがスタートさせたRedis向けインメモリデータストアサービスに含まれることになる。

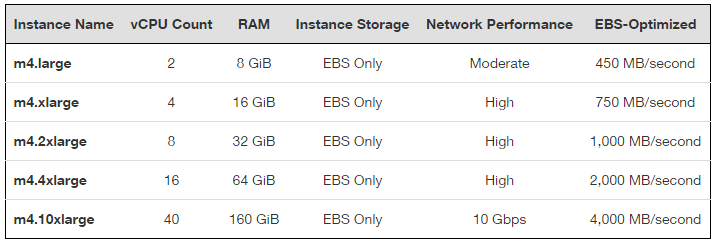

米国時間4月3日の発表でMemorystoreのプロダクトマネージャー、Gopal Ashok(ゴパル・アショク)氏は「Redisは今後もセッションストア、ゲームのリーダーボード、ストリーミング分析、マルウェアの脅威検出、APIレート制限などのユースケースで引き続き人気ある選択肢だろう。現在、Memcachedはデータベースのキャッシュのレイヤーとして頻繁に利用されている。デベロッパーはMemcachedをセッションストアにもよく用いている。我々の新サービスを利用すれば、インスタンスごとにメモリのクラスターのサイズを最大を5TBまで拡張できる」と述べている。

このサービスは名称のとおり、オープンソースのMemcachedと完全に互換性がある。従ってデベロッパーはコードに手を加えることなくMemcachedプロトコルを利用した既存のアプリケーションをGoogle CloudのMemechacedプラットフォームで運用することができる。

フルマネージドサービスなので作動のモニタ、パッチの適用などの定型業務はすべてGoogleが処理する。最大キャッシュサイズを決める部分にはやや職人技が残るが、Google Cloudでは「詳細な統計を提供するのでデベロッパーはインスタンスの大きさを上下させ、実行するユースケースに対して最適なキャッシュサイズを容易に設定できる」としている。Googleが提供するモニタ情報は Cloud Monitoringによって測定される。これはGoogle Cloudの中心的ダッシュボードであると同時にAWSの動作も計測できるという。

現在、Memorystore for Memcachedは Compute Engine、Google Kubernetes Engine(GKE)、App Engine Flex、App Engine Standard、Cloud Functionsで実行されるアプリケーションに使用できる。

Memcachedの利用に関しては、AWSがElastiCache for Memcachedで同種のサービスを提供している。またMemCachierなどこのプラットフォームの利用を専門とするスタートアップがある。Redis Labsも、フルマネージドのMemcachedサービス、Memcached Cloudを提供している。このサービスはAWS、Azure、Google Cloudで実行できる。

画像クレジット:Krisztian Bocsi/Bloomberg/Getty Images(Googleのベルリンオフィス)

[原文へ]

(翻訳:滑川海彦@Facebook)