I/O でのセンセーショナルな発表からひと月後、Googleはさらに改良されたDuplexを少数のジャーナリスト向けにデモした。場所はマンハッタンのイーストサイドの大型タイ料理店。Googleが新しいプロダクトのデモをするにはいかにも不似合いな場所だ。

テーブルは片付けられ、3脚ずつ3列、あわせて9人分の椅子が明るいディスプレイに面し、サイドのデスクが即席のコントロールセンターで、Google社員4人が配置されていた。ここでGoogleはI/Oのキーノートで発表され賛否の議論 を沸騰させた新しいプロダクトDuplex をデモした。

I/Oカンファレンスが行われた陽光輝くマウンテビューのショアラインアンフィシアターとは180度雰囲気が違うニューヨークの高級タイ・レストランが舞台となったのには、しかし、十分に理由があった。GoogleはいよいよAIを駆使した音声ベースの予約アプリをデモした――レストラン、Thep Thai のオーナーは「われわれは毎日100件からの予約を受けているのでこうしたアプリが登場するのは願ってもないことだ」と称賛した(Googleによればアメリのスモールビジネスの6割はオンライン予約システムを備えていないという)。【略】

秘密主義で名高いGoogleとしては、進行中のプロジェクトのベールを一部なりと外すのは珍しい。しかしDuplexにとって情報の透明性は成功のカギとなる要素だ。自動運転車と同様、この種のシステムは現実の世界で繰り返しテストされ、可能なかぎりバグを潰しておく必要がある。

VIDEO

I/OのキーノートでCEOのスンダル・ピチャイは「これからGoogleアシスタントが本当のヘアサロンに電話して予約を取るところをお聞かせする」と述べた。

(Googleアシスタント)ハイ、クライアントの女性のヘアカット、1名予約をお願いします。えー、5月3日はどうでしょう?

(ヘアサロン)オーケー、ちょっと待ってください。

(Googleアシスタント)アーハー…

〔下のビデオでは1:08あたりから通話が再生される〕

VIDEO

ここでカンファレンスの聴衆はジョークだと思って笑った。それから本物だと気づいて喝采した。実際、意味がわかっても信じるのは難しい。電話しているのはAIベースの純然たるロボットだ。それが「えー」と口ごもったり、「アーハー」と頷いたりできるとは。

実はこうした無意味な音声は言語学では非流暢性(speech disfluencies)として知られ、現実の発言で頻繁にみられる重要な要素と考えられている。Duplexの発言が驚くほど自然に聞こえるのはこうした非流暢性を巧みに利用している点が大きい。

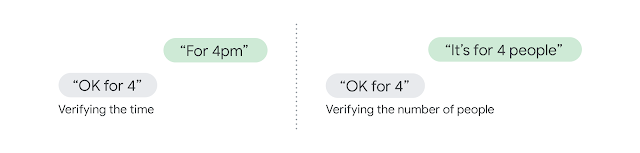

またDuplexが相手の返事をはっきり理解できなかった場合にも非流暢性は役立つ。受付担当者が電話の声を聞き取れなかったり聞き違えたりすることは普通にある。たとえば「4人のグループの予約をしたい」と求める場合、「えー、席を4人分です」と表現を変えて言い直すことができる。ここで「えー」は自然さを増し会話を円滑に進めるために効果がある。

こうした細部がDuplexを正しく作動させる秘密となっている。これは私の体験からそうだと言える。実は今回のデモで私はタイ・レストランの受付係の役でGoogleアシスタントの電話を受けたからだ。I/Oでアンフィシアターの巨大スクリーンに写し出された会話も本物だった。さらに興味深いのは、この電話はぶっつけ本番だっただけでなく、電話をかけているのがGoogleアシスタントだとはヘアサロンも知らなかったことだ。Googleがヘアサロンに知らせたのは電話の後だったという。【略】

ただしGoogle Duplexテクノロジーが実用化されるためには、情報の透明性が必要だ。つまり自分が人工知能であること、会話は録音されていることをまず最初に開示しておく必要がある 。

Googleはプロダクトを紹介したブログ にこう書いている。

会話が快適に進められるよう、〔Duplex〕テクノロジーは自然に聞こえねばならない。ユーザーにとっても店舗にとってもサービスの使用体験が快適であることが重要だ。透明性はこの点でもカギとなる。われわれは、ビジネス側がコンテキストを正しく理解できるよう、電話の意図、性質をできるかぎり明確にするよう努める。具体的な手法については今後数ヶ月かけて実験していく。

Duplexの透明性に関するメディアでの議論を受けて、Googleの担当者は「Duplexは情報開示機能を組み込んだデザインとする。これにより受け手がシステムの性質を正しく認識できるようになる。われわれがI/Oで紹介したのは初期段階のテクノロジーのデモであり、今後は各方面からのフィードバックを取り入れながらプロダクトに仕上げていく」と付け加えている。

現在のDuplexの通話はこのような形式でスタートする。

ハイ、私はGoogleアシスタントです。クライアントに代わって予約の電話をしています。これは自動通話で録音されています。

Duplex自身はAIだと名乗っていないが、Googleアシスタントに馴染みがあればおそらくそう気づくだろう。ただし録音されていることは告げている。Googleでは音声、テキスト双方を記録し、品質の検証と今後の改善に役立てるとしている。

タイ・レストランでのデモでGoogleアシスタントの電話を受けたとき、最初の部分を繰り返させようとしてみた。騒々しいレストランなどで電話を取ったとき最初の情報開示部分を聞き落とすことは大いにあり得る。しかしアシスタントはかまわず予約内容に進んだ。つまり受け手が情報開示部分を聞き落とした場合、今のところ繰り返させる方法はない。ともあれ、現在の段階ではそのようだ。録音からオプトアウトしたい場合は電話を切るしかない。しかし常連客を増やすためにはあまり勧められない方法だ。

この点について、Googleのエンジニアリング担当アシスタント・バイスプレジデント、 Scott Huffmanによれば「われわれは『オーケー、では録音しません』と言わせるメカニズムはもっている。ただ、具体的にどのようにすればよいか検討中だ。電話を切ればよいのか? 録音を破棄すればよいのか?」と説明した。

私も含めてデモに参加したジャーナリストはシステムをまごつかせようと全力を挙げた。アシスタントが午後6時の予約を取ろうしたので私は店が開くのは午後11時だと答えた。マンハッタンにはとんでもない営業時間の店がいくらもある。アシスタントは諦めて礼儀正しく電話を切った。

ここでDuplexの「聖杯」となるのは「予約のチューリングテスト」に合格することだ。Duplexが混乱すると Googleが用意した人間の担当者が引き継ぎ、いってみれば、飛行機を安全に着陸させる。人間の補助要員はDuplexのテストに常に付随する。Googleによれば誤解が手に負えないレベルに拡大しないよう、当分の間、Dupelxは人間が後見するという。この方式でどの程度の規模まで実験を拡大できるのか注目だ。

もっとも今回のデモではわれわれは誰もDuplexの後ろから人間の要員を引き出すことはできなかった。それでも現在のシステムの限界をいくつか知ることができた。たとえば、「最後の4桁を繰り返してください」と言うとアシスタントは電話番号を全部繰り返した。これは間違いではないが、やはり人間の会話の微妙なニュアンスを理解できていない。一方、メールアドレスを尋ねると、システムは「クライアントから〔メールアドレスを明かす〕許可を得ていません」と答えた。

GoogleによればDuplexは現在5件中4件は全自動でタスクを完了できるという。80%の成功率ならたいしたものだと思うが、Googleではさらに改良を進めている。【略】

好むと好まざるととに関わらず、Duplexは近々現実のものとなる。これを避けるには電話を使わないことしかないかもしれない。

[原文へ ]

(翻訳:滑川海彦@Facebook Google+ )