ポーランドのデータ保護機関は3月末、EUの一般データ保護規則(GDPR)に基づいて初の罰金を科した後、面白い決定を下した。

表面的には、この措置はさほど大事には見えない。ポーランドの個人データ保護局(UODO)は、同国に支社を置く欧州のデジタルマーケティング企業Bisnode(本社はスウェーデン)に対して、同社がGDPR第14条に定められたデータ主体の権利に対する義務を履行していないことを理由に、わずか22万ユーロ(約2740万円)の罰金を科した。

しかしその決定は、第14条に規定された通知義務による通知を受け取っていない600万人近い人たちに、連絡を取ることも要請している。UODOが同社に与えた猶予は3カ月だ。

Bisnodeは、これだけの数の書留郵便を送るには、そのための経費を一切含めないとしても、およそ800万ユーロ(約99億8500万円)かかると前もって見積もっていた。

つまり、GDPRに基づくデータ保護の強制力は、これまでに科せられた最上級の罰金よりもずっと威力があるということだ。この付随命令には、商習慣を大きく変えてしまう可能性すらある。

ポーランドの報道機関によると、Bisnodeは、違反しているデータを削除すると話しているという。数百万通の郵便物を出さずに済ませるための方策だ。さらに同社は、UODOの決定に対し、まずはポーランドの法廷に異議を訴える構えを見せている。その根拠は、データ主体にそのデータの処理について通知する場合、データ管理者はどこまで努力し、どこまで金銭的な負担をしなければならないかを示した第14条の補足説明にある。

同社は、必要に応じて、欧州の最高裁判所まで行く覚悟だという(我々は、次の対策に関してBisnodeに確認をとった)。

もしこれが欧州司法裁判所にまで持ち込まれることになれば、UODOの決定に対する法的な異議申し立により、個人データを無断で抽出することに関して、制限の範囲が明確化(または規定)されることになる。可能性としては、ビジネスインテリジェンス、広告、サイバー攻撃諜報活動といったいくつもの業界や分野の運営方法に影響を与えることが考えられるるため、プライバシーの保護に携わる人たちは注目している。

「この決定は、第14条を文字通りに適用したという点で過激に思えます」と、サイバーセキュリティーおよびプライバシーの独立系アドバイザーおよびオックスフォード大学Center for Technology and Global Affairs(技術および世界情勢センター)研究員であるLukasz Olejnik博士はTechCrunchに語った。

「UODOは、この企業のビジネスモデルが抽出したデータの処理に完全に依存していて、それを意図的に決断していると、原則論に則って主張しています。UODOはまた同社は義務のことを認識しており、一部の人たちに電子メールで通知しているとも言っています」。

さまざまな業界で活動する個人データ抽出業者には裁判になれば膨大な出費が強いられる可能性が生じるが、Bisnodeの主張が通るかどうかによって分別ある処分が下されることもあるとOlejnikは言い添えた。

このようなデータ保護機関の決定が、無断のデータ抽出を事実上禁止することになるかは定かではない。

しかし、欧州の公的データベースから、人々の個人データを、黙って、取り放題に取っていた業者には、不明瞭な法律上の心配ごとが現れた。個人データを、当初の使用目的とは違う商売に利用しようとすれば、想像を超える大金が必要となるのだ。

知らされる権利

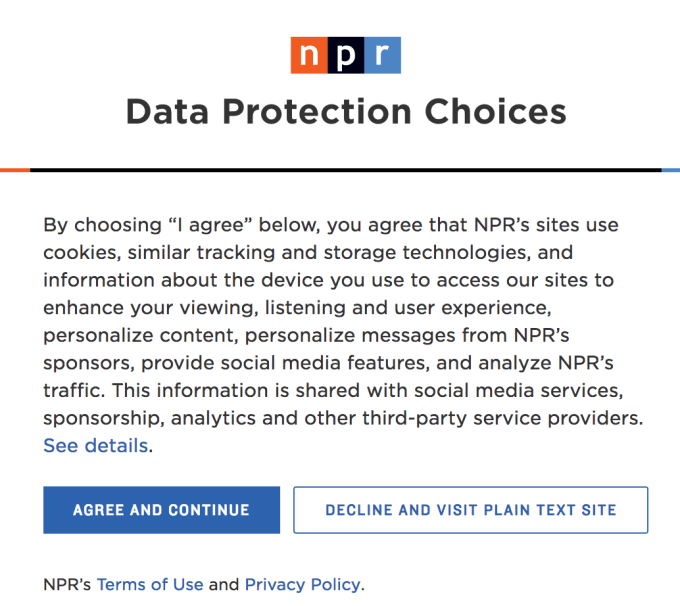

GDPR第14条では、データ管理者は、当事者から直接取得したものでない個人データを使用する際には、その人に通知する義務を負うことになっている。例えば、公的インターネットから個人データを抽出したような場合だ。

これに関連する規制の条項はとても長いのだが、要点を並べると次のようになる。個人データを抽出したときは、データの持ち主であるデータ主体(個人)に、誰がその人のデータを持っているか(それを共有するすべての者、また海外への転送を依頼した者を含む)、どのようなデータを取得したのか、それを何に使うのか、その処理に関する法的根拠を通知しなければならないということだ。

データ主体には、自分のデータの利用を望まない場合に拒否できるよう、苦情を訴える権利があることも知らせる必要がある。

情報に関する義務は、使用目的によって異なる。そのため、データ管理者が、抽出したデータを後に別の目的に使おうとする場合には、新たに第14条に基づく通知をしなければならない。

データ主体には、データを抽出してから(または使用目的を変えるとき)遅くとも1カ月以内に通知しなければならない。そのデータが、データ主体に対する直接的なマーケティングに使われる場合は、最初に接触するときに、即刻その旨を伝えなければならない。

Bisnodeの場合、無数の起業家や個人事業主に関する公的記録やその他の公的データベースから、さまざまな個人データを入手している。それには、氏名、国民ID番号、事業に関連するあらゆる法的事柄が含まれる。

個人事業主や企業の住所は、抽出対象としては一般的なデータのようだが、それ以外の連絡先は違う。Bisnodeが入手した電子メールアドレスは、少数の個人集団のものだけだった。その後、同社はその人たちに、14条に基づく義務としてメールを送っている。

しかし問題となっているのは、電子メールアドレスを知らないその他の人たち、つまり大多数の570万人ほどの人たちに、Bisnodeがテキストメッセージや郵便を送らなかったことだ。同社は彼らに直接コンタクトを取ることを諦め、代わりに同社のウェブサイトに通知を掲示して、第14条の義務を果たしたことにしていた。

「個人事業主には、我々がその人のデータを使わせていただく旨を知らされる権利があることを、私たちは認識しています。今回の場合、BisnodeはGDPR第14条に準拠し、私たちのウェブサイトに情報を掲示しました」と、BisnodeはUODOの決定を受けて発表した最初の声明文に書いていた。これは彼らのウェブサイトにも掲載されている。

さらに、「私たちは、データ保護機関が考えるところの相応の努力というものに疑問を持っています。電子メールアドレスを知っている方々(67万9000件)には、第14条に基づく情報を電子メールにて通知しています。しかし、個人事業主、法人などの570万件の記録に対しても郵便または電話で通知せよとの追加要求は、相応の努力とは思えません」と続く。

「私たちは、電子メール、その他のデジタルチャンネル、全国新聞の広告などが、受け手にとっても、送り手にとっても望ましい手段だと考えます」。

UODOは激しく反論した。それが、この罰則やその他の措置につながった。

UODOは、その決定についてこう説明している。Bisnodeは、第14条に基づく義務について明らかに知っていた。そのため、ビジネスに利用するために取得した個人データの持ち主の大多数には直接通知をしないと、費用の面だけを重視して意識的に決断した。データの取得に関連する法的義務は、事業コストの中核要素だと認識すべきだった。

「UODO局長は、同社が個人事業を運営する個人(現在または過去)の住所情報(一部には電話番号も含む)を取得した場合、決められた情報を郵送する(または電話で知らせる)ことが可能であり、規則2016/679第14条第1項および第2項で要求されている情報を単純に同社のウェブサイトに掲示するだけでは、規則2016/679第14条第1項から第3項の用件を十分に満たしたとは認められないと述べている」と法律用語満載で応じている(ポーランド語の声明をGoogle翻訳で英語に翻訳)。

「こうした活動を本業とする企業として、同社は、事業者としての立場を明確にする必要があり、法的規則(この場合は個人データの保護に関する規則)に確実に準拠するための必要経費を考慮しておかなければならない」と続き、とくに人々の個人データの売買を事業の柱としている企業であるにも関わらず、費用がかかり過ぎるという理由で大多数の個人に通知をしなかったBisnodeの判断こそが問題だと強調した。

UODOの決定はさらに、Bisnodeが電話番号を知っている人たちにショートメッセージを送ることもしなかったと指摘している。これは「そうした行動には多額の費用がかかる」という言い訳への反論だ。

同社は、第14条に基づく通知を570万人に郵送するには800万ユーロかかると見積もっているが、UODOは、書留で送れとはどこにも書かれていないと反論する(Bisnodeの見積もりの根拠は書留のようだ)。実際、どのような通信媒体を使っても構わないことになっている。

従って、(より安価な)普通郵便で送ってもよかった。または従業員(アルバイトなど)に、数日間かけて対象の個人に通知を配らせてもよかった(余談ながら、ロボットやドローンを使って規則に準拠するための通知を配る新しいタイプの事業が成立するかも知れない。第14条配達ロボットがドアをとんとんノックして、権利を読み上げてくれるとか)。

UODOは、GDPR第14条には、通知の義務を果たすための手段は特定していないと指摘する。データ管理者が実際に連絡することだけが求められているのだ。

積極的な姿勢と過大な努力

「義務を果たすことの要点」は「積極的」に行動することにあると、声明文には書かれている。つまり、データ主体に通知をする際には、データ主体が自分のための通知を受け取るために、データ主体自身が手を煩わすことがないようにしなければならない。

そのため、Bisnodeが行ったような、ウェブサイトのタブの中に通知を掲示するという受動的な方法は、その要点に反する。明らかにデータ管理者には、通知すべき人を探し出す努力が求められているのだ。

また、そのデータの持ち主が、自分のデータを抽出されていることすら知らない場合、どこへ見に行けばよいのか。そもそも見に行くのか? Bisnodeのウェブサイトでその通知にたまたま行き当たって、事の経緯を知るなんてことは、まずあり得ない。大々的にマスメディアで放送でもしない限りは不可能だ。

「積極的な通知の必要性が、2017年11月29日に採択された規則2016/679の第29条作業部会ガイドライン(2018年4月11日に改訂)で強調されている」と、UODOの決定に関する文書には書かれている。EU全体を管轄し大きな権限を持つデータ保護監視機構(現在は欧州データ保護会議、EDPB)の基準を示し、欧州全域でGDPRに確実に準拠するよう、継続的に努力する責任があるというのだ。

この決定に関する広報資料でUODOは、通知を直接受け取った後(電子メールなど)、Bisnodeが自分のデータを使うことを拒否した人々の数と割合も示している。「同社がデータの使用を通知したおよそ9万人のうち、1万2000人以上が自分のデータの使用を拒否した」

これは、個人データを商用目的で、あるいはマーケティング関連で使いたいと通知すれば、多くの人から「やめてくれ」と断られる可能性があるという事実を明らかにしている(実際に拒否する人は多い)。この結果は、データベースを最大限に利用したいと考えているはずのBisnodeのようなマーケティング企業の意向に沿っているとは言えない。

しかし、マーケティングデータベースの縮小は、人々のプライバシーを守り、欧州で合法的にビジネスを行うための代償なのかも知れない。第14条で言われている「相応」とはどの程度かに関するBisnodeの解釈は、欧州連合の市民の権利ではなく、自社の事業の利益を基準とした利己的なものと思える。

もし、欧州連合の人たちの、自分のデータがどのように使われるかを知る法的権利が、たとえば、データ管理者がごく限定された連絡先情報しか持たないことを理由に軽視されてしまうのなら、データ保護の枠組みに大きな抜け穴ができてしまう(数年前、UODOは類似のケースで、企業が自由に使える連絡先情報を持っていなかったとして、今回とは異なる決定を下している)。

第14条には免責の条項もある。データ主体への通知義務を果たそうとしたとき、「それが不可能だと証明されるか、過大な努力を要する場合」は免除される可能性があるというものだ。しかしそれは、「とくに、公益のための記録保管、科学的および歴史的研究、統計上の目的において」という非商用目的の例を示した文章に、明確につながっている。

どう見ても、b2bマーケティングの事業にに当てはまらない。

データ主体への通知義務の免責はまだある。「実行がほぼ不可能な場合、またはデータの使用目的の達成を著しく阻害する場合」だ。だがこれも、Bisnodeのようなマーケティング目的に当てはめるのは難しい。

たしかに、第14条に基づき通知した人たちからは苦情があった。そのなかに、自分のデータをマーケティングに使って欲しくないと拒否する人たちが一定数いた可能性がある。とは言え、UODOが調べたところでは、Bisnodeのデータ使用に積極的に反対した人の数は少数(13パーセント以下)であり、同社の事業全体を「著しく阻害する」ほどの破壊的な数ではない。

もちろん、こうした細かい事柄をもとに判断を下すのは裁判官だ。しかし、「相応の努力」とはどの程度のことを言うのか、そしてどのような条件で第13条の免責が適用されるのかが、大きな争点になってゆくだろう。

「第14条(5)の『過大な努力』が問題の根幹です」とOlejnikは認めている。「場合によっては、ウェブサイトに情報を掲載するだけでも十分ですが、それが今回のケースに当てはまるかどうかは不透明です。むしろ、これに関わる人の大多数が、自分のデータが利用されていることを知らないのは明らかです」

「裁判所の判断は、誰にも予測ができません。とても興味深いケースとして注目しています」と彼は話していた。

UODOの決定から、差し迫った現実的な意味が読み取れるかについても、今はまだはっきりわからないとOlejnikは言う。Bisnodeが、欧州司法裁判所まで戦う姿勢を見せているので、なおさらだ(つまり、結論は何年も先になることを意味している)。

「同社は、EU内の他の支社でも同じ対策をとっているが、各国のデータ保護機関には何も言われていないと公表しています」とOlejnik。「しかし、なんらかの形の通知義務は果たさなければなりません。これは興味深い先例になると考えています」

「これを衝撃的と感じる人もいるでしょうが、GDPRを実際に施行すると、こうなるのです。施行前、GDPRの文言の意味がわからないと、多くの人が不安に感じていました。データ保護機関は、私が思うに、文面通りの意味としてとらえているのでしょう」

個人データの膨らむコストとリスク

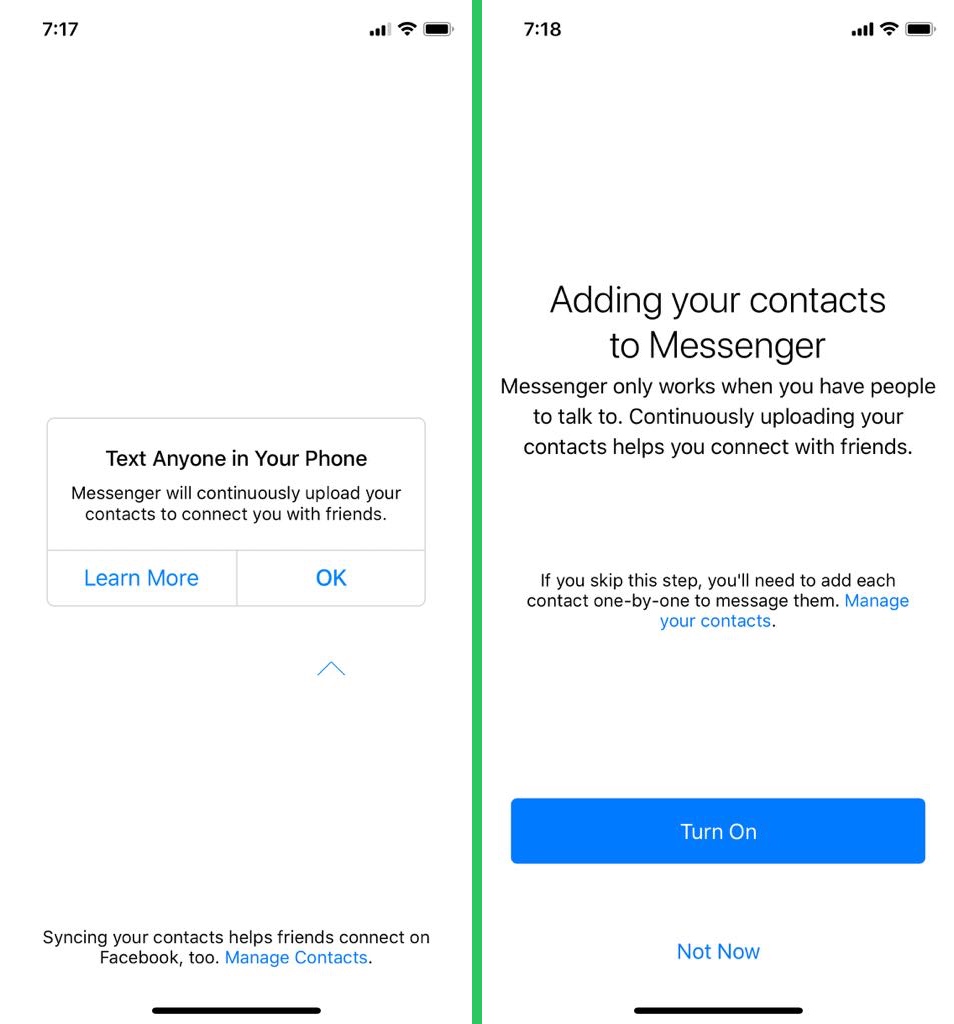

現在まさに、同じような話が同時進行している。インターネットの広告ターゲティングに関連するGDPRの元での「自由意思とインフォームドコンセント」の問題だ。昨年、GDPRが施行されて以来、大きな法廷闘争を引き起こした。さまざまな広告用データ技術プラットフォームを使ったターゲティングには苦情が絶えない。適切な同意もなく、なかにはデータ保護が十分に行われていない状態で個人データの使用や分配を行う中核的な広告技術のデータ利用への非難も跡が絶えない。

GDPRは施行されてまだ1年も経ってないため、その規制を強要する手段が不足している。だが規制当局は、その境界に、平等でしっかりとした線を引こうとする兆候は見え始めている。

説明を曖昧な文章にしたり、広告技術産業による個人データの露天掘りを合法であるかのように見せかける努力の跡を見れば、こうした高度にシステム化された個人データ収集業者も、同様に、すべての個人に適正に通知するにはコストがかかりすぎると見積もっているのだろう。

また、広告に利用したい個人データの持ち主全員に、完全に丁寧に情報を通知し、拒否する自由を与えてしまえば、広告技術産業は、そのマーケティング力の大きな部分をもぎ取られてしまう。

だからと言って、義務から逃れることはできない。法の目をかいくぐり身を潜めている企業には、かならず手が入る。

視野を広げてみよう。インターネットから個人データが抽出される場合と、利用者から積極的に個人データが提供される場合(自由意思で提供されるものだけでなく、たとえばGDPRが「同意の強要」と呼ぶものも含む)の割合は明らかではない。

「その割合を示すデータを大きな規模で入手するのは困難です」とOlejnikは言う。

インターネット上での「完全に無許可」のデータ収集を行い、違法なスパム広告を流したり、フィッシング詐欺を企むハッカー集団に売却する悪辣な連中が大勢いることはたしかだ。そいつらを確実に封じ込める規制は、公にはまだ存在しない。だが、法的なリスクが高まれば、少なくともサイバー犯罪者たちの動機を奪い、弱体化させることができる。

規制によってさらに厳しい罰則がもたらされる商業分野では、企業はデータの抽出と「提供」との境目を、自分たちの都合のいいように曖昧にしてしまう。法律から逃れるにためにだ。

そこで、ここでもまた、人々の個人データが丁重に扱われるためのはっきりとした定義と線引きが必要となる。それには法学に支えられた、しっかりとした法執行判断が欠かせない。

また、今はなき選挙コンサルティング企業のCambridge Analyticaの不正行為も忘れてはいけない。同社はFacebookのプラットフォームから個人データをこっそり抜き取り、国内の政治情勢を動かそうと、アメリカ人有権者のサイコグラフィックプロファイルを作っていた。これは、明らかに第14条に違反する。データ保護政策が施行されている現在のEUで、市民たちにそのような行為が行われたらの話だ。

Cambridge Analyticaのような悪質な例を見れば、個人データが内密に利用されることから人々を守る枠組みを作ったGDPRの明確な意図がわかる。そこには、好ましくない不正使用を監視する機能が与えられた。Facebookは、利用者のデータを適切に守れなかった残念な失敗の長い歴史を残すこととなった。

GDPRなら、Cambridge Analyticaのような悪役の活動を止められたのかどうかはわからない。しかし、この制度に焼き込まれた多額の罰金は、個人データの抽出が2014年当時のように「タダで取り放題」ではなくなったことを示している。

同時に、欧州ではFacebookのいくつかの事業が捜査を受けている。アイルランドのデータ保護機関は、Facebook所有の複数のプラットフォームで10件の公開捜査を行っている。GDPR違反の疑いだ。注目しておこう(Facebookがプライバシーに関する姿勢を即座に「転換」したこともに注目して欲しい)。

個人データを内密に大規模に収集すれば、少なくとも欧州では、今や大きな法的リスクを負うことになる。

UODOが第14条に関連して強気な姿勢を見せたことで、個人データを掻き集める人たちは、また少しやりづらくなったはずだ。

完全な情報公開

UODOとBisnodeの事件の締めくくりとして、お伝えしておく。奇妙なことに、UODOは同社の名前を公にしないことを決めた。社名には仮称を使い、決定に関する公開文書では、一部の詳細事項が編集されている。

UODOが、なぜそうしたのかは定かではない。なぜ企業名を隠すのかも不明だ。Olejnikは、仮称はすぐに暴けたと話している。だがBisonodeは、その後、自ら名乗り出て異議を唱えた。

欧州の他国のデータ保護機関は、一般原則として違反企業の名前を明かすことにしている。それだけに、ポーランドの保護機関の選択は異様だ。

UODOの報道官は、TechCrunchに対して、違反した法人の名前を常に伏せるわけではないと話した。しかし今回の件は、「行政処分の情報とその正当性は十分に示されている」という大統領の見解を踏まえてのことだという。さらに、市民に伝えるべきもっとも重要な事柄は、決定が下されたことと「彼らの実績」であり、決定に至るまでの過程に関する決定的な論拠も詳細に記されているとのことだ。

しかし、その具体的な正当性に欠け、とくに仮称の不完全さから、Bisnodeの名称を公開しなかった判断には疑問が残るとOlejnikは言う。

「今回の決定に関する情報から、わずかな時間で仮称の解読ができ、企業名が判明しました。このことから、仮称を使った意図が疑われます」と彼は指摘する。「一般市民には、まず第一に透明性を求める権利があります。仮称の使用は、最初に論争を呼びました。控えめに言っても、それは、利用者がこの事件のこと、データの不正使用のこと、さらには自分がそこに関わっているかどうかを知る権利を妨害しています」

プライバシーを守る側の機関が、下手に企業名を隠し、個人データを密かに盗まれた大勢の人たちに正しい情報が伝えられなかったことは、大きな皮肉だ。

[原文へ]

(翻訳:金井哲夫)

The Met failed to consider the human rights impact of the tech

The Met failed to consider the human rights impact of the tech