人間は何かが起きたのを見たり聞いたりした時、すぐにそれを言葉で表現できる。「青いシャツの女の子が、野球選手の投げたボールをキャッチした」とか「犬が海辺を走っている」とか。私たちにとっては簡単なしごとだが、コンピューターにとっては恐ろしく大変だ ― 幸い、IBMとMITが協力して、それを少しやさしくする方法を検討している。

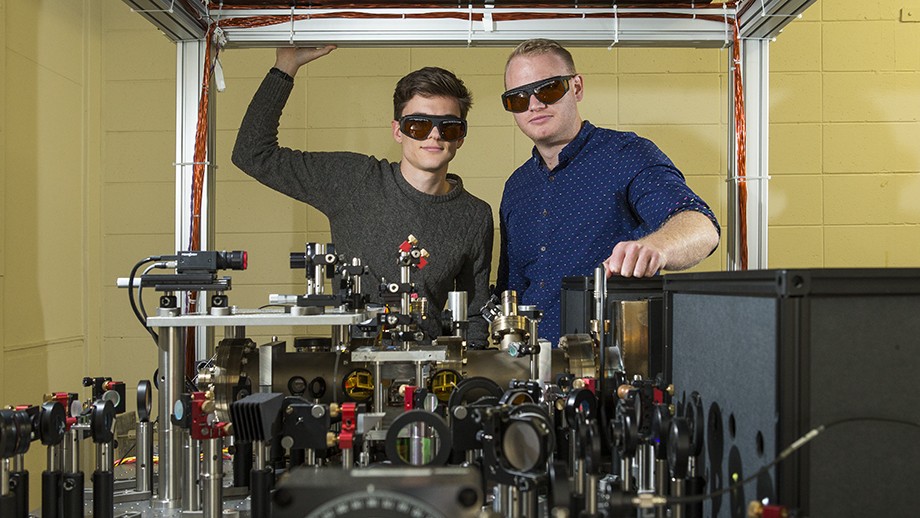

新設の “IBM-MIT Laboratory for Brain-inspired Multimedia Machine Comprehension” (略してBM3Cと呼ぶことにする)は両組織による複数年にわたる共同プロジェクトで、コンピュータを使った視覚と聴覚の問題を集中して研究する。

チームを率いるのは、MITの脳認知科学科長、Jim DiCarloで、同学科とCSAIL(コンピュータ科学・人工知能研究所)およびIBMのWatsonチームのメンバーが新研究所に参加する。両組織間に金銭の授受はなく、特定の製品開発も行わない。活発で願わくば成果を伴う相互援助が生まれることを目標としている。

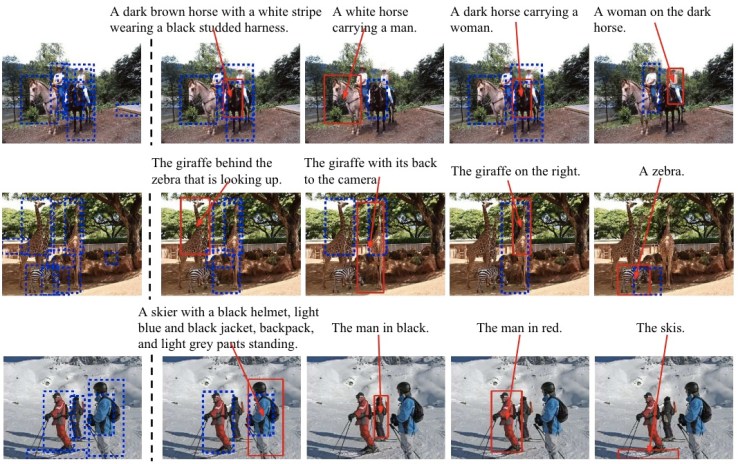

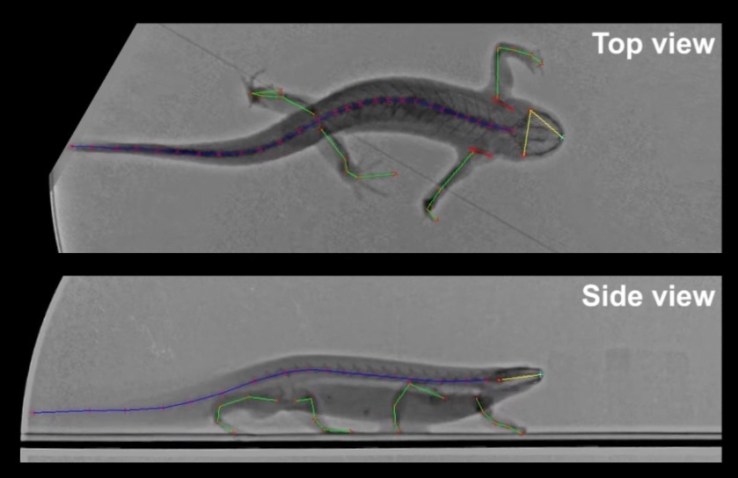

視覚情報処理の問題は様々な専門分野にわたるため、様々な方向から取り組む必要がある。例えば、カメラで物体を綿密に追跡できたとしても ― 物体を背景から切り分ける方法を知らなければ役にたたない。それができたとして ― 物体を認識できなかったら? さらには物体同志の関係も確定させなくてはならない…いずれも人間の脳が最も得意とするところだ。

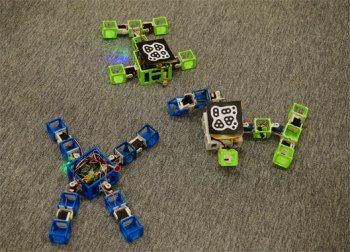

これは研究所の名前に “brain-inspired”[脳からアイデアを得る]が入っている理由でもある。 人間の神経回路網の働くしくみをモデルにしたバーチャル神経回路網を使うことによって、研究所ではコンピュータが周囲の世界を解釈する方法について、あらゆる種類の興味深い成果を生み出してきた。

MITとのこの共同研究は、IBMが最近いくつか実施してきたものの一つだ。同社の認知コンピューティング担当VP、Guru Banavarが、ブログに詳細を書いている。他の共同研究には、意志決定のためのAIの研究、サイバーセキュリティー、言語のディープラーニング等がある。IBMは間違いなくAIの基礎研究に多大な投資をしてきており、万全の準備を整えようとするのは当然だ。これらの共同研究全体で、”Cognitive Horizons Network” と呼ばれるグループを構成している。

「現在われわれは、AIシステムの安全で倫理的な運用を支援するための、ベストプラクティス・システムを準備している。そこでは社会の規範や価値との一致も考慮される」とBanavarは書いている。

それがどんなものであるにせよ、社会の規範や価値が変化する速さを踏まえると、10年後の社会がどうなっているかも、どんなAIができているかも予測することは容易ではない。

[原文へ]

(翻訳:Nob Takahashi / facebook)