最近、アメリカでは多くの人々がデバイスを装着して普段見られない珍しい光景を眺めた。残念ながらそれはVRヘッドセットではなかった。人々が皆既日食を観察するときに使ったのは専用メガネだった。VRに暗い影を投げかけるニュースだった。

今年のE3(Electronic Entertainment Expo) で目立ったのはOculus RiftというよりむしろOculusという谷間(rift)だった。最近HTCはVive VRヘッドセットのキット価格を200ドル値下げした。Facebook傘下のOculusはRiftの価格をこのサマー・セールで399ドルまで下げた(夏が終われば値上げする予定だが、その幅は小さい―499ドルになるはず)。両社は皆既日食に対抗して消費者の関心を引き戻すために値下げ競争を始めたわけではあるまい。

TechCrunchの同僚、Lucas Matneyはこう書いている。

ここ数ヶ月、HTCとOculusのハイエンドVRヘッドセットにおける競争はどちらがVHSでどちらがベータかを争う戦いではなかったことがはっきりしてきた。両社とも〔ビデオテープではなく〕レーザーディスクの地位に転落するのを防ぐのに必死なだけだった。まだ有力プレイヤーは認めようとしていないが、投資家やアナリストはこの1年のVRヘッドセットの売れ行きに強い懸念を抱いている。

HTCもFacebook/Oculusも販売台数を公表していないという事実そのものが、販売が低調であることのなによりの証拠だ(アナリストの推定ではそれぞれ50万台以下)。

この2月、ソニーが Playstation VRヘッドセットの販売数を発表したときには一瞬期待が高まった。同社によれば2016年10月の発売以後、 91万5000台が売れたということだった。しかし6月になってもこの数字はは100万台を超えるのがやっとだった。

VRヘッドセットは夏向きの商品ではないのだろうか? 皆ビーチに出かけてInstagramでセルフィーを撮っているせいでVRは忘れられてしまうのかもしれない。

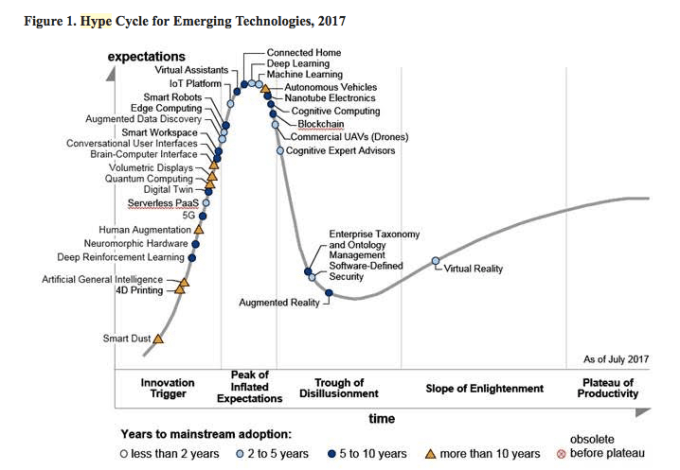

ハイプ・サイクルを急降下

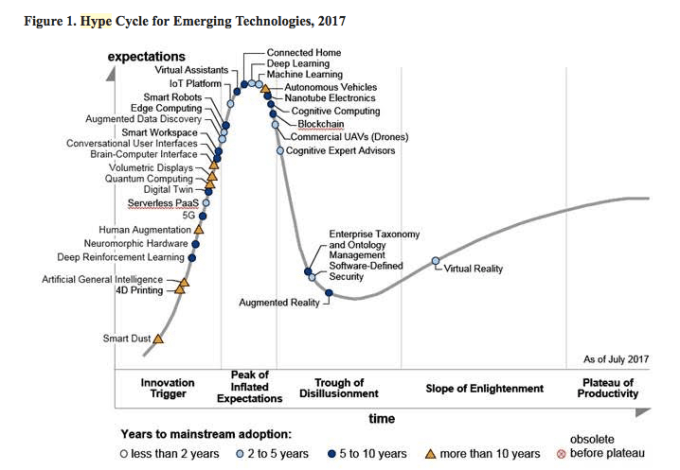

ガートナーが発表した2017版の新しいテクノロジーのハイプ・サイクルのレポートによれば、VRテクノロジーは「回復(啓蒙)期の坂を上昇している」とされている。しかしこれは寛大すぎる判断だろう。

いずれにせよVRがハイプ・サイクルの頂上から一挙に転落したことはガートナーも認めているわけだ。インフレ評価の頂上から幻滅の谷間への急降下はすでに起きており、VRデバイスの現在の能力に比べて価格は依然として高止まりしていることもあって消費者の需要は最低の水準だ。

ガートナーが示唆するようにVRの前途に、ゆるい角度であれ、上り坂が控えているなら良いニュースだが、それにしても長期間の苦闘が必要だろう。

ガートナーはVRはすでに幻滅の谷間を後にしていると評価するが、すくなくとも近い将来、VRというテクノロジーに対する熱狂は復活しそうにない。ガートナーはVRがメインストリーム入りの幸運を引き当てるために2年から5年程度が必要だとしている。私には5年というほうが現実的に思える。

逆にVRはメインストリームにはならない、ニッチにとどまるテクノロジーだという意見もある。

どちらが正しかったか分かるようになるには時間がかかりそうだ。ともあれVRは、溺れてはいないものの、水に落ちて苦闘している。

最近、私は熱狂的なVRファンの起業家と話をした。彼は近い将来VRがリビングルームの中心となると信じている。ガールフレンドと並んでソファに腰掛けテレビの画面に代わってVRヘッドセットを眺めるようなるというのだ。

なるほどひとつの考えには違いないが、私には奇妙に思えた。

いくらソファに並んで座っていようと、あのVRヘッドセットを付けた2人がどうやって微笑、目配せ、身じろぎといったコミュニケーションができるだろう? またVRヘッドセットが消費者に広く受け入れられるためにはハードウェアとして劇的に改良される必要がある。普通のメガネに近い程度まで軽量化される必要があるし、現実の外界と仮想現実の表示を瞬時に(おそらくは人工知能を用いて)切り替えることができなければならない。並んで座っている恋人に向かって振り返ると自動的にVRがフェードアウトして恋人の表情が判別できるようになるなどだ。

正直そのレベルにまで柔軟性が高まるのでなければテクノロジーとして十分とはとはいないだろう。

もちろん現実のVRはエンジニアリングとしてもソーシャルメディアとしてもとうていその段階にはない。

何年も前から評判になっているもののまだプロダクトの形が見えないMagic LeapのIRLというある種の混合現実にしても同様だ。

キラーコンテンツ不在

業界トップクラスのゲーム開発者に話を聞いたことがある。彼の会社はOculusを始めとするVR全般に当初から強い関心を抱いており、その当時は彼もVRの将来に強気な見通しを持っていた。しかし最近再びVRの現状について尋ねてみたところ、その返事は「5年経ったらまた聞いてくれ」だった。

ゲーム開発者はまた有力なコンテンツが現れていないことについても触れて次のように述べた。

〔VRテクノロジーには素晴らしい可能性があるものの〕例えていえば、任天堂が革命的なゲームプラットフォームを作っただけで宮本氏とソフト事業部を売り払い、その後何も新しいゲームを作っていないような状況だ。VRには有力なコンテンツが決定的に欠けている。OculusはJason Rubinをトップに据えて巨額の投資をしているが、この点では失敗を続けている。

ソニーのデバイスはエレガントだが、処理能力が不足しており、PS4レベルのグラフィクスの表示も十分にできない。

現在、トップラスのVRを体験するには1000ドル程度のキットが必要になる。しかし消費者はかさばる上にケーブルが煩わしいVRヘッドセットを嫌っており、そんな金額を支払う気はまったくないというのが現実だ。

ハードの売れ行きが鈍いこと以上に利用率が低いのも致命的だ。VRのハードをすでに所有しているユーザーは新しいソフトを買おうとしていない(すくなくともビジネスとして意味あるレベルの売上になっていない)。

VRが成功するためには現在の任天堂のようなコンテンツとブランド・パワーが必要だ。しかしそのようになる兆候は見えない。

つまり古典的な「ニワトリが先がタマゴが先か?」というジレンマに陥っている。

Job SimulatorはVRを数分体験するには面白いゲームだが、世界の消費者をとりこにするような力はない。

VRゲームのJob Simulatorはバーチャル・オフィスで新しい職を体験できる

【略】

VRはSecond Lifeの没入版になる危険性に直面している。悪くすると「Second Lifeの運命はVRの失敗を10年も前に予言していた」といった記事が書かれかねない。

VRは次のハイプ・サイクルで復活するかもしれいない。そうであってもエコシステムの無視は致命的だ。

「VRは最低だ!」(動画はVRシューティングゲームでピストルのマガジン交換に手間取っているところ)

ARには大きな可能性がある

現在いちばん利用されているVRはモバイルデバイスを利用したエントリー版だろう。Samsung Gear VRや Googleの段ボールを折って自作できるシステムがそうだが、それであってもブームを作るほどの売れ行きではない。しかもこうしたVRは本当のプロダクトというよりジョークの混じったギミックだ。

私見によればVRのディストピア的性格を遺憾なく表現したのは2016年のカンファレンスで撮影された写真だ。Facebookのファウンダー、マーク・ザッカーバーグが引きつり気味の微笑を浮かべながら通路を進んでくるというのに、着席している聴衆は誰一人それに気づいていない。全員がヘッドセットを被って外界から切り離されているからだ。

FacebookのCEO、マーク・ザッカーバーグが 2016のSamsung VRイベントに到着したところ

ウェアラブルデバイスであっても通常のメガネとあまり変わらないサイズに必要な機能を詰め込んだAR〔拡張現実〕やMR〔混合現実〕デバスなら外界の情報を遮らないので、こういった馬鹿げた事態は防げる。

もちろんGoogle Glass(Glassholeと呼ばれた)という大失敗の例は忘れてはならない。あまりにもギーク臭丸出しのデバイスは一般ユーザーからは強く拒否される。

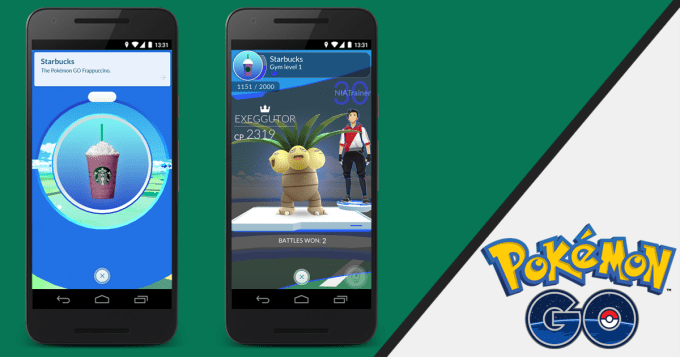

興味ある点だが、モバイルARはすでに膨大なユーザーを集めるソーシャル・テクノロジーになっている。しかもヘッドセットなどのウェアラブルデバイスを一切必要としない。手持ちのスマートフォンだけでよい。コンテンツはすべてスマートフォンだけで完結する。

つまりSnapchatのセルフィーやFacebookのライブビデオのフィルターなどの機能だ。AIを利用してユーザーの顔を置き換えたり加工したりできる人気アプリは数多い。

Snapchatの顔加工セルフィー・レンズ

【略】

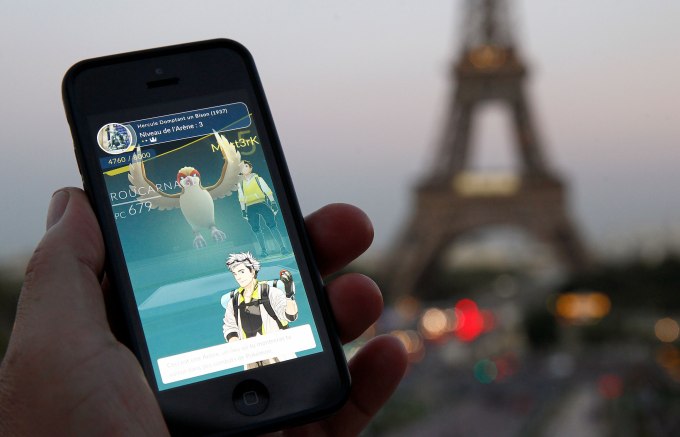

旅行者がパリのエッフェル塔の前で任天堂のポケモンGOをプレイ中( 2016年9月8日:: Chesnot/Getty Images)

【略】

Facebook Spacesで友達とバーチャル・ミーティング

【略】

逆にモバイルARがすでに巨大なユーザーを集めていることは明白だ。

ポケモンGOのイベントに集まった人々

なるほど任天堂には巨大なブランド力があり、Snapchatなクレージーなまでにチャット・ブームを巻き起こした。そうではあってもモバイルARが本質的のソーシャルであることに変わりはない。現在でも友達がスマートフォンを手にして集まり、会話しながら写真を取り合い、(準リアルタイムで)互いの写真を眺めたり共有したりするという光景を見ることがある。これは初歩的なモバイル・ソーシャルARの例と言っていい。

ここではオンラインとオフラインの体験をシームレス(に近く)混合でき、さらに友達の表情やボディーランゲージを認識することを妨げるようなものがない。

一方で高価なVRハードウェアはアーリーアダプターの家やデスクの引き出しで埃をかぶるままになっている。VRにガートナーの言う「啓蒙」が訪れるのはいつだろうか?

このサイクルは死んだ―5年後にはどうなるだろう?

つまり現在のVRは死んだ。

しかしVR業界では、これは単に現在のハイプ・サイクルが終わりを迎えたにすぎないと望んでいる。 5年後か何年後かはともかく、次のサイクルでは新しいエコシステムを確立できるに違いない――だがそれはどんなものになるのか?

映画館にはプレミアム席が設けられ、新しいテクノロジーを用いて一層完全な没入感を得られるエンタテインメントが提供されるかもしれない。飛行機の乗客向けのサービスも一つの可能性だ。教育、訓練、医療、リハビリなどの分野における応用のシナリオが考えられる(VRポルノも忘れてはならない)。

しかしこうした応用分野をすべて足し合わせてもVRが次世代のコンピューティング・パラダイムの主要な部分にはならないだろう(ザッカーバーグでさえVRが「可能性をフルに発揮できるようになるには10かかる」と述べるようになった)。

今のところAR > VRだという点に疑問の余地はない。

しかもARに勢いがつくことはVRにとって悪いニュースとなる可能性がある。【略】

結論

人間の本性として世界を風変わりなフィルターを通して観察してみたいという気持ちは強い。

しかし、今のところ仮想現実は人間に知られているエンタテインメントの中でもっとも人気がないツールという不名誉な賞を得るにとどまっている。この傾向にはまったく変化の兆しがない。

実はアメリカでは比較的近い未来にまた皆既日食を観測できる。それが起きるのは2024年の4月だ。もし次回の皆既日食でも人々が古典的な日食メガネをかけており、VRメガネについては関心がないようだったら皮肉な事態ということになる。

記事タイトルはTechCrunchnの同僚、Romain Dilletのアイデア。トップ画像はBryce Durbinのオリジナル・アート

[原文へ]

(翻訳:滑川海彦@Facebook Google+)