GoogleのChromecastは、この検索の巨人を秘かに本格的なホームエンタテイメント企業に変えてしまいそうな、かわいらしい外見にパワーを秘めたメディアエンジンだ。このおちびエンジンに対応しているアプリケーション(もっとも典型的にはYouTube)のユーザが画面上の小さなボタンを押すと、コンテンツをテレビの大画面で楽しめる。この“Castボタン”はこれまで、合衆国だけでも15億回押された。そしてChromecastは、Googleのほかの船も浮上させている…たとえばYouTubeでは、Chromecastユーザの総視聴時間が従来より45%増加した。

Chromecastやその対応デバイス(Nexus Player、Nvidia Shieldなど)は、今年のI/Oカンファレンスで発表されるいくつかの新しい機能により、さらにパワーアップする。一言で言うと、これまでの単純なストリーミングマシンから、本格的なメディアデバイスに変身し、Chromecastとその操作デバイス(スマホなど)は、近未来のホームシアターやメディアルームの基本装備になる。Chromecast向けの開発をやっているデベロッパや、一般ユーザは、期待をふくらませて待つ価値があるだろう。

オートプレイとキューイング

ストリーミングTVがふつうのTVらしくなるためには、長時間の連続視聴が可能でないといけない。たとえばNetflixのようなWebアプリケーションでは、とくにユーザが操作しなくても複数のコンテンツを次々と‘上映’することができる。今度からChromecastでも、それができる、しかも、どんなコンテンツでも。

これをデベロッパのボキャブラリで言うと、最初のビデオが再生されているときに次のビデオをバッファリングしてキューを作り、一つのコンテンツが終るたびに次のコンテンストをユーザが指定する、という手間をなくす。しかもユーザはキューをコントロールして並び順を変えたり、新しいコンテンツを途中に入れたりもできる。これだけ高度なキューイングは、今のNetflixでもできませぬ。

今このAPIを導入しているアプリケーションは、NBA Game TimeとRed Bull TVぐらいだが、ほかのメディアアプリケーションも視聴者を長時間釘付けにするために当然導入するだろう。

ゲームマネージャAPI(マルチデバイス/マルチプレーヤーを簡単に)

複数のユーザが複数のデバイスを使ってChromecast対応のゲームを楽しめることは、元々この製品の大きな売りの一つだったが、これまでは乗り気でないデベロッパが多かったため、各人のスマートフォンをコントローラにしてTVに映しだされるゲームをシェアする遊び方は、あまり盛り上がらなかった。

しかし今度からはGame Manager APIというものが導入されるので、デベロッパにとって仕事がすごく簡単になる。ゲームに参加するデバイスはiOS、Android、Chromecast対応デバイスなど何でもよく、デベロッパはそういうマルチプレーヤー体験を容易に作れる。ローンチタイトルとして提供されるCatch Phraseは、よくあるパーティーゲームだが、この機能の活用例としては好適だ。

“マルチデバイス/マルチプレーヤは機能は最初から好評だったけど、それをもっと、デベロッパにとって使いやすくしたい、と考えた”、Chromecast担当VP Rishi Chandraはこう語る。“今では、モバイルゲームのデベロッパのほぼ全員が、このユーザ体験を作り出そうとしている”。

そこでGoogleは、TV画面上で共有されるスコアボードなど、共通的な機能を管理できるようにし、また個々のプレーヤーとデバイスのレベルでの、正しいセッション管理ができるようにもした。こうしてついに、Game Manager APIが誕生した。

ぼくはいつも感じていたんだけど、モバイルゲームも一人プレイはもう古い、マルチデバイス/マルチプレーヤには、未開拓の大きな可能性がある。これまでは、開発の難度と、参加〜プレイの容易化単純化正確化がネックだった。でもこの二つの大きな難点を、このAPIは克服できる。

リモートディスプレイAPI(iOSとAndroid)

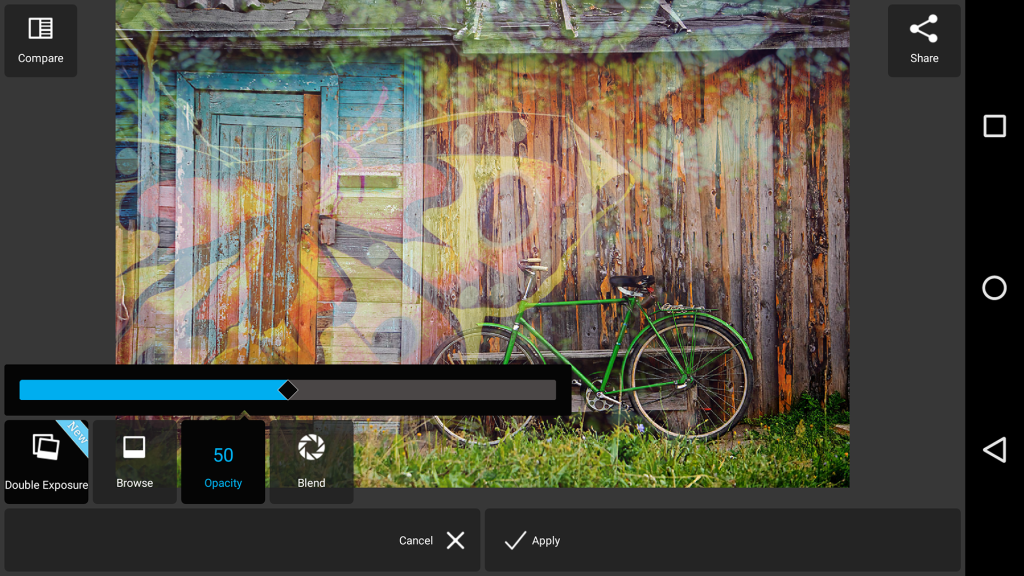

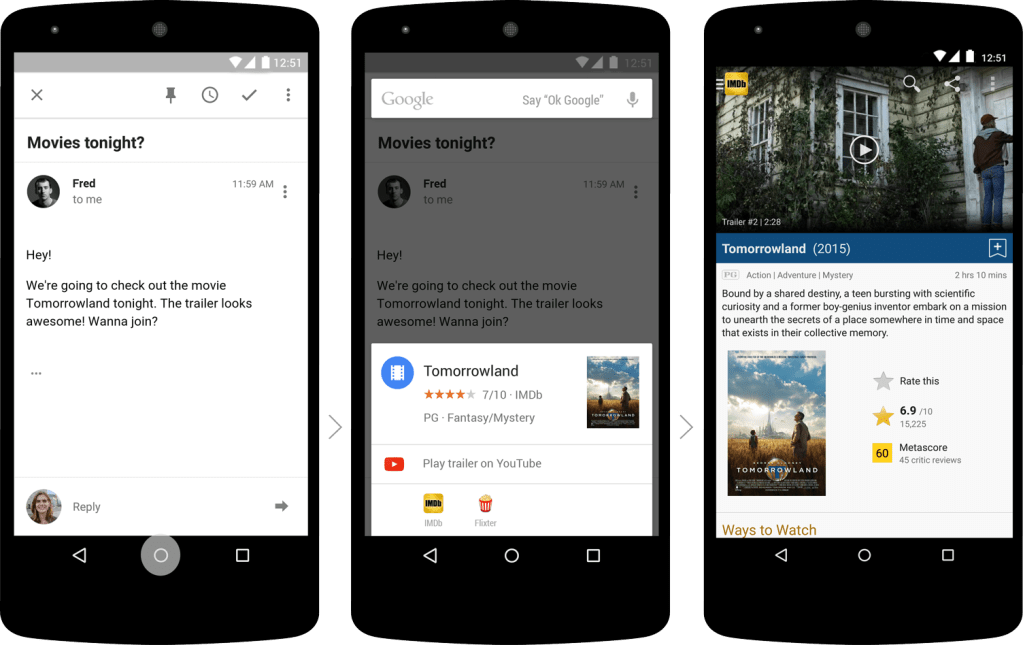

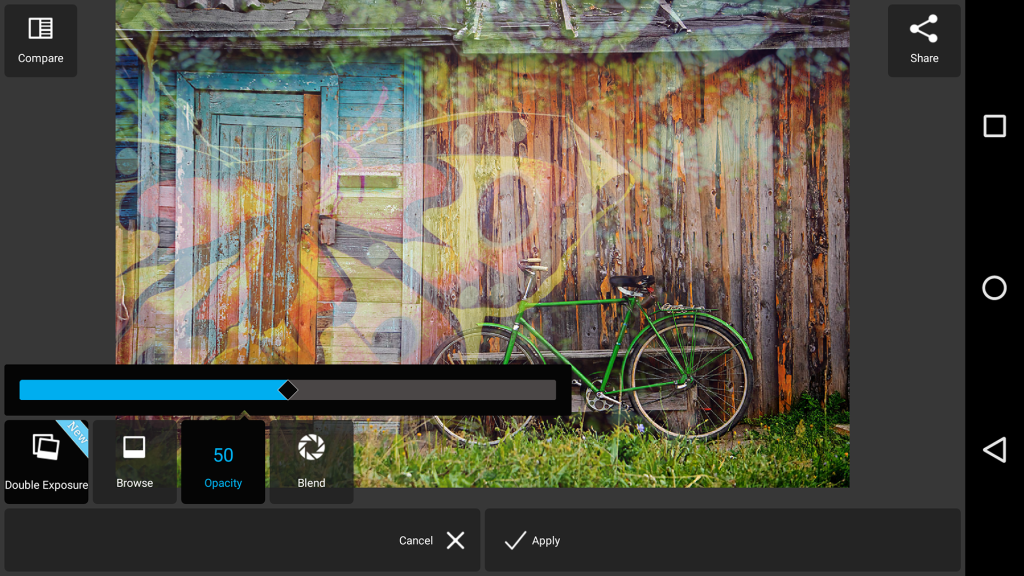

スクリーンの二重化(デュアルスクリーン…ゲーム画面はTV、コントローラ画面はスマホ)はもちろんゲームにとって大きな意義があるが、Chromecastおよび対応ハードウェアを操作するAndroidとiOSアプリのための(ゲームに限らない)ジェネリックなAPI、Remote Display APIは、デュアルスクリーンの意義をさらに大きくする。これによりたとえば、TV(+Chromecast、〜対応デバイス)の画面にカーレースが映っていて、スマホ上では仮想ステアリングホイールを操作する、ということができる。あるいはTVの大画面を利用して写真の編集〜修正をやっていて、その細かい操作をスマホ上のUIでやる、といった“適材適所”の役割分担ができる。

このAPIの初期のバージョンを実際に使っているのが、Autodesk Pixlrだが、これを見るとまさに、マルチディスプレイが新しいタイプのユーザインタフェイスだ、ってことを実感できる。Chromecastはこの、コンピュータシステムの歴史上かつてなかった、斬新な利用インタフェイスを支えるのだ。クリエイティブアプリ/アプリケーションはもとより、世界中のユーザ数がもっとも多い生産性アプリ/アプリケーションにとっても、これは朗報だ。それに、デスクトップアプリケーションがもっと多様な状況でモバイルにリプレースされるためにも、こんなインタフェイスがその基盤に必要なのだ。対象を見る画面は大(&高精細)、手による操作は手元の小型デバイス、という理想の仕事環境が、今後、社会の至るところで普及するだろう。

[原文へ]

(翻訳:iwatani(a.k.a. hiwa)

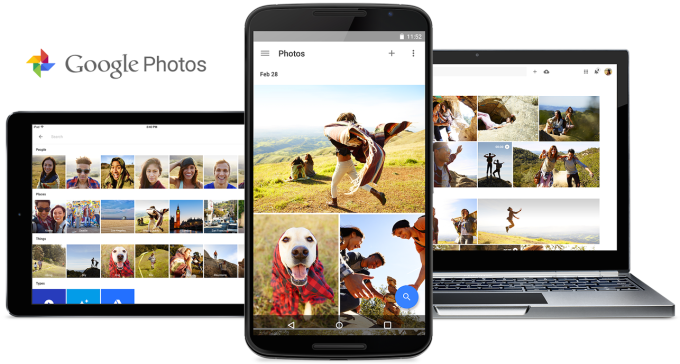

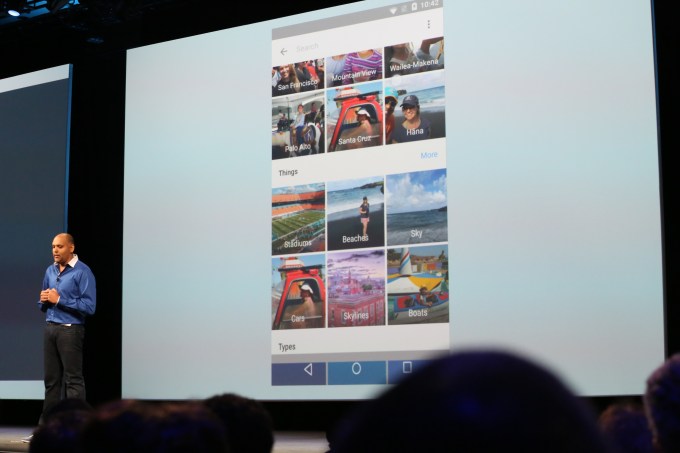

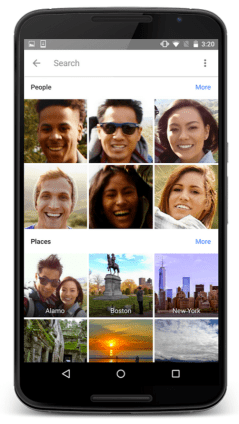

Googleには、ある。同社の持つコンピュータービジョン、機械学習、人工知能を始めとする高度な技術を活用すれば、写真に写っている人々、場所、物等を認識し、そのデータをユーザーの個人情報と結び付けることができる。お気に入りの炭酸飲料やオートバイと一緒に写っている写真から、そのユーザーに見せるべき広告がわかる。ランドマークから識別された位置から、何を探しているかを推測できる。そして、友達との自撮り写真から、Googleは誰とシェアするよう薦めるべきかのヒントを得られる。

Googleには、ある。同社の持つコンピュータービジョン、機械学習、人工知能を始めとする高度な技術を活用すれば、写真に写っている人々、場所、物等を認識し、そのデータをユーザーの個人情報と結び付けることができる。お気に入りの炭酸飲料やオートバイと一緒に写っている写真から、そのユーザーに見せるべき広告がわかる。ランドマークから識別された位置から、何を探しているかを推測できる。そして、友達との自撮り写真から、Googleは誰とシェアするよう薦めるべきかのヒントを得られる。 ユーザーを無料ストレージで誘惑することによって、Googleはわれわれの持つ膨大なメディアを手に入れ、同社の機械ビジョン学習システムを教育すると同時に、広告やサービスを改善しようとしている。そして、人は大量の思い出を移動したくないので、Google Photosはユーザーをさらに強く自社のアプリやサービスに結び付けることができる。Googleに情報を与えすぎることを懸念する人もいるだろうが、われわれは既にメールの管理を任せており、さほど悪い結果を招いていない。

ユーザーを無料ストレージで誘惑することによって、Googleはわれわれの持つ膨大なメディアを手に入れ、同社の機械ビジョン学習システムを教育すると同時に、広告やサービスを改善しようとしている。そして、人は大量の思い出を移動したくないので、Google Photosはユーザーをさらに強く自社のアプリやサービスに結び付けることができる。Googleに情報を与えすぎることを懸念する人もいるだろうが、われわれは既にメールの管理を任せており、さほど悪い結果を招いていない。