【編集部注】著者のShahin FarschiはLux Capitalのパートナー。

強力なツール、すばらしい才能、そして熱心な投資家からの際限のないドルの流れによって、明日のテクノロジー企業を始めるには、今は素晴らしいタイミングである。好奇心に溢れ野心的な創業者チームたちが、現実の問題を解決するためにそのスキルを注ぎ込んでいる。以下に述べるのは、私たちの未来を明るく照らす、9つのエキサイティングなスタートアップカテゴリの中で、共通する落とし穴を避けながら、堅実な価値を構築する方法についてである。

画像:Bryce Durbin/TechCrunch

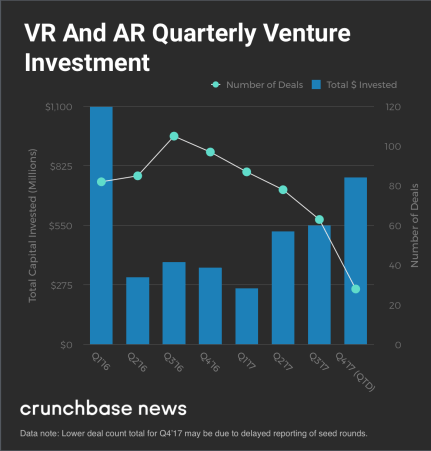

拡張そして仮想現実(ARとVR)

仮想現実と拡張現実は、もうすぐ来ると言われ続けてほぼ10年が過ぎている。しかし、新しいVRコンテンツ、ポータル、ハードウェアが目白押しなのにもかかわらず、従来の2Dコンテンツが相変わらず主役の座を占めている。

避けるべきこと:コンシューマーハードウェアを開発してはならない。その通り、仮想現実ヘッドセットは高価で嵩張るものである。一方、拡張現実の忠実度はまだ低いままだ。Magic Leapは、ハードウェアの製造とマーケッティングに必要な膨大な資金を調達するという素晴らしい仕事を成し遂げた。しかし、コンシューマエレクトロニクスの設計、製造、販売、マーケティングのビジネスは、一般にはスタートアップの対象外である。

Sony、Google、Samsung、LG、Lenovo、HTC、そしてAppleのような企業は、そうした機械から利益を得ることができるし、まるで際限がないかのように、資金をそれらの作業に注ぎ込むことができる。その一方で、他のスタートアップたちは、VR/ARコンテンツを消費させる場所になろうとしている。そしてスタートアップたちと同様に、Amazon、Netflix、Apple、Google、そしてFacebookといった大手企業たちも、自身のプラットフォームのためのマーケティングに資金を投入し、それを育てるためにコンテンツに資金を提供している。

やるべきこと:消費者を引きつけて、彼らがお金を払い、時間を捧げてくれるような魅惑的なコンテンツを作り上げることに向けて努力しよう。Atariは、消費者が約800ドル(インフレ調整済み)を支払っても良いと思わせるだけの、魅惑的な体験を生み出すことに成功した。そのグラフィックとサウンドはいまではお話にならない位貧弱だが、Atariの初期のタイトルの成功は、イマドキのコンテンツに惨めな思いをさせるほどのものだ。

2Dのコンテンツに化粧を施してよしとするのではなく、ARならびにVRネイティブな体験を生み出すクリエイティブな才能が必要とされているのだ。パン、ズーム、そしてセリフなどで動画と写真が区別されるようなものだ。ゲームセンターや映画館に相当する、VRコンテンツを消費する場所が必要とされているのだ。残念ながら、人々が携帯電話をヘッドセットとして使用したり、家庭内に機器を設置したりすることは、もはや狙うべき戦略ではない。 ARとVRのコンテンツはまだPong時代を迎えてもいないのだ(PongはAtariが最初期に出したシンプルなビデオゲーム)。

画像:Bryce Durbin/TechCrunch

AI

学者や大企業は、AIをPRの材料に使っている。計算コストの低下によって、この何十年も前から存在する技術は実用的なものとなった、そして小切手を読み取り、写真の中から猫を見つけ出すアルゴリズムなどが拡大解釈されて、やがて殺人ロボットが世界を支配するのでは、という恐れにつながっている。

避けるべきこと:最高を目指すAI企業を立ち上げてはならない。投資家たちと才能がこのセクシーなキャッチフレーズに向けて引かれ合った日々は、終わりに近づいている。ユニークな実現技術で新たな数十億ドルベンチャーを始めて成功するよりも、AIが既存の製品やビジネスをより良くできる可能性の方が遥かに高い。

「AI企業」をスタートさせることは、クラウド企業、モバイル企業、インターネット企業を設立することに相当する。Salesforce、Facebook、Amazonの陰には、数千もの失敗したスタートアップがあった。また、自分たちの利便性のために、この技術を活用した多くの既存企業も存在している。失敗したスタートアップたちは、なんとか資金を調達し、誇大広告で人を集めることはできたものの、実際のビジネスを構築するための戦略に欠けていたために、それほど前には進むことができなかったのだ。

やるべきこと:AIを製品の改善や新しい市場へのアクセスのために用いる、多くのツールの1つとして活用する方法を探そう。理想的には、AIを優れた製品を支える秘密の武器として使ったり、特定のカテゴリの顧客にリーチして効率的に獲得するための道具として利用したりすることが望ましい。実際に、マーケットから会社を「AI企業」だとは見て欲しくない筈だ、その代わりに(見えない所でAIが支えている)魅力的な製品で新しい市場を切り拓く企業だとみてもらおう。

ハードウェアアクセラレーションAI

AIチップ企業は白熱している。IntelによるNervanaの4億ドルでの買収と、Nvidiaの株価の急騰が触媒となって、データセンターや、携帯ならびに組込機器上で、ディープニューラルネットを訓練するチップを開発するスタートアップたちが続出した。

避けるべきこと:従来のデジタルチップ設計をAIに向けて最適化しようとしてはならない。チップ会社を作ることは本当に難しい。多くのチップ会社が売上を増やすまでにあまりにも長い時間がかかったことで失敗している。チップ企業たちは複雑な製品を、気紛れで、保守的で、果てしないサポートを要求してくるエレクトロニクス企業に対して売っている。チップ会社が、少量しか購入してくれない顧客のサポートで手一杯になって、潰れてしまうことはありがちだ。チップのスタートアップたちは、より良い経済性を達成するために、新しいテクノロジーを追求して、より多くの資金を調達しなければならなくなり、顧客との間に一大転機でも起きない限りはその動きが繰り返される。

やるべきこと:顧客たちに対して、あなたのチップを使えばできることは何かを尋ねよう。さもなくば、現在のサプライヤー(Intel/QCOM/Nvidia/TIなど)のチップではできないことについて尋ねてみよう。もしパフォーマンス、コスト、サイズなどの改善が10倍に及ばない場合は、キッチンナイフで銃撃戦に臨むようなものだ。どうすれば、あなたの桁違いの改善が、新しいカテゴリーの製品につながる可能性が出てくるのかを考えよう。Broadcom、Qualcomm、InvenSense、Atherosなどの成功したチップ企業は、どれもみな新しい製品カテゴリー(ケーブルモデム、携帯電話、モーションセンシングビデオゲームコントローラ、ラップトップと携帯電話のWi-Fi)を可能にした。あなたのチップはどんな魅力的な製品を可能にするだろうか?

画像:Bryce Durbin/TechCrunch

宇宙技術

インターネットから宇宙に目を向けた起業家Elon Muskは、航空宇宙関係者でなくても奇想天外な会社を作ることができることを世界に証明した。

避けるべきこと:宇宙経済のインフラ整備に焦ってはならない。Mark Twainの言葉として引用されるものに「歴史はそのまま繰り返されることはないが、しばしば韻を踏む」というものがある。投資家たちは、産業革命が進行している最中、鉄道建設のために何十億もの損失を抱えたが、 鉄道輸送に依存した産業たちに莫大な利益をもたらした。また投資家たちはインターネットのインフラを整備する間にも、何十億ドルという金を失ったが、eコマース、ソーシャル、モバイル、そしてSaaSたちがそれを活用して利益を得た。衛星打ち上げ事業、宇宙通信、鉱業、マイクログラビティ実験室などの見通しはそれとは全く違うものになるのだろうか?

やるべきこと:大規模な既存市場および将来の市場に対応するための宇宙を活用したビジネスを構築しよう。SpaceXは、政府および商用衛星事業者の既存のニーズに対応するために、事業を開始した。Planetは頻繁に地理空間画像を安価に取得する新しい市場を創出するために、新しいデザインの衛星を開発し運用している。

通信衛星を開発、打上げ、サービス、あるいは提供する計画をまとめる前に、宇宙そのもののことはとりあえず忘れて欲しい。いま事前のコスト(衛星を設計し、製造し、打ち上げるなどのコスト)が必要な総括的な事業を立ち上げていると仮定してみよう。そしてそれにはロングテール型のキャッシュフローが伴っているとする。このキャッシュフローは、その事業が地道なものであろうと奇想天外なものであろうと、他のどのプロジェクトよりも実質的に高い収益(財務用語では、IRR:内部収益率)を達成しなければならない。その収益率は、まだ成功することが証明されていない製品や、新興市場のリスクを補うのに十分なほど高い必要があるのだ。

画像:Bryce Durbin/TechCrunch

自動運転車

自動運転車への道のりに横たわる、数々の問題に打ち勝っていく会社を始めたいという誘惑に逆らうのは難しい。ではその問題とは…

避けるべきこと:1点もののソリューションを提供する会社を立ち上げてはならない。およそ50程の大企業が、様々なレベルの技術を追いかけている。コンピュータービジョン用のセンサーから、人間と物との弁別、振舞予測、運転計画、他の車や道路との通信などまで、様々なものがある。一方バックエンドには、開発ツールや地図、そして車を安全に保つためのサイバーソリューションを開発する企業がたくさんある。

残念なことに、自動運転技術はあまりにも初期段階であるため、これらの要素をどのように組み合わせるかということも未定である。私が好きなたとえ話は1960年代の計算機事情だ:そのころIBMはなんでもやっていた。チップや回路基板の製造から、メタル・キャビネットの折り曲げ、そしてマシン上で実行される、プログラミング環境、コンパイラー、およびアプリケーションに至るまで全てを提供したのだ。もしIBM謹製の、スクリーンやキーボード用の掃除用具があっても私は驚かないだろう。

やるべきこと:あなたが売り込もうとしているサプライチェーンの流れを、近くで真剣に観察しよう。もし従来の自動車向けの運転支援機能を提供しようとしているのなら、既存の自動車業界のサプライチェーンの性質を理解しなければならない。なお伝統的にそれはスタートアップにとっては非常に過酷なものである。他のスタートアップたちが討ち死にをしたマーケットで、会社が生き残り繁栄できる程の、ユニークで特別な何かを、あなたの会社は持っているのだろうか?

もしロボットカーの技術を開発しているのなら、多くのスタートアップたちや大企業のR&Dグループによって開発されているシステムに、あなたの技術はどれくらい簡単に適用することができるのだろうか?私の予想:それは簡単ではないだろう。テクノロジーの開発を始めるずっと前に、顧客について知っておかなければならない。各顧客ごとに設計し直さなけれなならないような製品を、追い求めることは避けるべきだ。残念ながらそれは急速に成長しようとするベンチャーの足を引っ張るばかりなのだ。

画像:Bryce Durbin/TechCrunch

マンマシンインタフェース

心で機械を制御したり、機械で心を制御したりすることは、SFの領域に任されてきた。それが最近では、科学者は現代のAIツールを活用して私たちの心の奥底を覗き込み、病気の治療や、機械に対する未来のインターフェイスの開発に応用しようとしている。

避けるべきこと:私たちの心で制御できたり、あるいは心を制御したりする機械(恐ろしい)を作ろうとしてはならない。私たちは信じられないほど洗練された脳-機械インターフェース、すわなち私たちの体、を持って生まれてきた。私たちはおそらく、車輪が発明される前から、話したり、歌ったり、踊ったり、描いたり、書くたり、音楽を作ったり、そして物語を語ることができた筈だ。棒の先の泥で描かれた単純な絵文字は、おそらく洗練された深層学習に裏打ちされた最高級のヘッドセットよりも、より良く感情を伝えることができるだろう。そして、私たちの幅広い視覚、聴覚、嗅覚、そして触覚は、私たちの直感と組み合わさって、私たちの脳に飛び込んでくる超高速道路の機能を果たしている。

やるべきこと:私たちの体に既に備わる、豊かな入出力システムと連携して、忘れられない体験を生み出そう。このアドバイスは聞いたことがあるって?その通り、AR/VRの創業者たちがすべきことと同様のものだ。ジョイスティックはAtariの成功の鍵となったが、ゲームセンターのユーザーに積み上げた硬貨を次々と投入させたり、親たちに800ドル以上(インフレ調整済)の金をAtari 2600に払わせたのはパックマンとPongというゲームそのものだったのだ。

視覚、聴覚、嗅覚と組み合わせ、おそらく個々人の履歴によって訓練された脳のインターフェースは、忘れられない経験をもたらすことができるだろうか?それぞれの個人に合わせて調整されて、他にはない官能的な体験につながるような、刺激の組み合わせを人工ニューラルネットによって生成することは可能だろうか?

画像:Bryce Durbin/TechCrunch

教育

私たちの教育システムは変革の時を迎えている。edXとCourseraが世界最高の教育者たちを、地球上のあらゆる場所に連れて来ているが、そこにはまだ革新の余地がある。

避けるべきこと:私たちの古典的な教育モデルの範囲内で構築してはならない。現在使われているシステムは大恐慌直後に発明されたものだ:それが生み出された時代は現在とは社会規範も、キャリアプロフィールも、雇用主も、そして学生からの期待も大きく異なっていた。私の父親の世代では、4年間の教育で生涯のキャリアのための準備を整えられると考えられていた。それに2年から5年間の大学院教育を加えることで、追加の収入とより強い雇用保証が約束されていた。

今日、学部で必要な25万ドルという学費に対して、それに見合った収入につながるという見通しは確実なものではない。伝統的な教育の要素を、電子プラットフォーム上に移植するだけでは、すでに混雑している教育用「製品」の市場に、単に別の選択肢を提供するだけのことだ。

やるべきこと:常に変わり続ける職場のニーズに必要とされるスキルを、常に予想し学生たちに与えることができるようにしよう。テクノロジーは労働のあらゆる側面に急速に浸透しており、ニュースで一般的に叫ばれていることとは異なり、それは労働者たちを置き換えようとはしていない。その代わりにそれぞれの能力を拡大しようとしているのだ(さらに詳しく後述する)。

学生と一緒に進化し、彼らのキャリアを通して寄り添い続ける教育ツールを発明しよう。価値ある生涯教育ツールは、職場の変化するニーズを予測し、自動的にトレーニングを提供する。このコンセプトは、医療従事者たちには新しいものではない。文献を追い続け、常に再認定され続ける必要がある。残念なことに、規制の緩い分野の専門家たちは、訓練を追求する先見性を個々人が持たなければならないが、年齢と共に家族への責任が重くなってくることがそのことを困難にして行くのだ。

さらに、医療以外の分野では知識は効果的に広められていない。AIを使用して、特定の分野のベストプラクティスを特定し、それらを広めることは可能だろうか?未来の教育ツールは、変化する労働に必要とされるスキルセットを予測し、パーソナライズされたトレーニングを提供できるだろうか?

画像:Bryce Durbin/TechCrunch

ブロックチェーン

暗号通貨(仮想通貨)の背後にある不安定性と投機性は、ブロックチェーン技術の力そのものと並んで、多くの起業家たちに、暗号通貨を使ったスタートアップの起業について真剣に考えさせている。

避けるべきこと:投機の勢いに飲み込まれて踊ってはいけない。多くの人が1990年代のIPOバブルを忘れてしまったようだ。その当時のことを振り返ってみれば、何らかの形で「インターネット」とつながりがある「いかなる」企業も、値上がりが期待されるという理由で公開を勧められていたのだ。間違って株式を買ってしまった者たちもいた。彼らの買った株はみるみる急上昇して行った…音楽が止まるまでは。なので、あなたの提供するコインが、ただコインだという理由だけで、適切だと考える投機家たちを食い物にしてはいけない。

やるべきこと:単純な質問をしてみよう:ブロックチェーン技術があなたのビジネスをどのように支えてくれるのか?それを使うことでユニークな製品は提供できるのか?それを使うことで、既存製品の売上は改善するのか?それを使うことで、市場への浸透性が増したり、ネットワーキング効果は高まるのか?

もしコインオファリングをやりたいと思っているのなら、ビジネスの成長に合わせてどのようにあなたの暗号通貨の価値が増えていくのかについての、はっきりとしたシナリオを描くべきだ。ブロックチェーンのどのような性質が、この価値創造の中核となってくれるだろうか?より多くのユーザーが参加し多くの取引が行われることで、どのように通貨の本質的な価値が生まれるのかについての、しっかりとした仮説を立てておこう。

画像:Bryce Durbin/TechCrunch

ロボット

ロボットが仕事を創造するのかそれとも破壊するのかについては、盛んに議論されてきた。パワフルな計算力、アルゴリズム、安価なセンサーとアクチュエーターは、創業者たちに面白い自動化企業を立ち上げるチャンスを与えてきた。このことによってより生産的で競争力のある人間の労働力が生み出される。

避けるべきこと:人間を置き換えようとしてはならない。歴史を通して、発明家たちは人間を模倣する巧妙なガジェットを作り上げてきた。しかし、最も成功したマシンたちは、人間の力を拡大するもので、それらを置き換えるものではなかったのだ。ロボット執事として働く、2足歩行のヒューマノイドを作ろうとしてはいけない。工場の床で、人間のいた場所に立つ仕掛けを作ろうとしてはいけない。受注処理センターの中を走り回り、人間よりも速く箱をピッキングするようなロボットを作ってはいけない。

やるべきこと:人間に力を与えよう。組立ライン技術は工場労働者の生産性をより高めたために、普及することができた。コンベヤーベルトとバーコードは、人間による仕分けや注文の取りまとめをより速くすることができたので、すべての受注処理センターに導入された。

工場や倉庫にはすでに多くの自動化が導入されている。これ以上人間を支援するにはどうすれば良いのだろう?そのロボット支援によって、収益にはどのような影響があるのだろうか?事業者の投資回収率はどのくらいだろうか?その回収された利益は、広く顧客に分配されるのだろうか?あるいは特殊なニーズを持った少数の見込み客に対して限られるのだろうか?

それが、車やiPhoneの組立であろうが、Amazonの受注処理であろうが、部屋の掃除だろうが、皿洗いであろうが、はたまたルームメイキングやグルメ調理であったとしても、尋ねられるべきことは以下の問いだ(1)そのロボットはどのように労働者の人生を良い物にできるのか?、(2)労働者の生産性の定量的な改善率はどのくらいになるか?要するに人間が中心なのだ。

ここでのアドバイスは一貫している:人間を重んじること。素晴らしく多様な人びとを引きつけて、強力な文化で絆を作り上げることで、あなたのスタートアップはわずかなリソースで予想以上の結果を生み出す力を得ることができる。投資家たちはこのような予想以上の業績達成動向を素早く把握し、より多くの人材を引き寄せるための資金を注入し、そのことが更に多くの売上を引き寄せる。こうして好循環が生み出され、あなたのスタートアップは競合相手より1歩先を行き、既存の大企業はバックミラーの中に小さくなって行く。そして新しい市場に力を与える新しい製品を可能にする新技術が創造され、すべての人類がその素晴らしい未来に近づくことになるだろう。

[原文へ]

(翻訳:Sako)

Synamonは企業向けのVR空間構築ソリューション「

Synamonは企業向けのVR空間構築ソリューション「

しかし、ナーブ代表取締役の多田秀起氏は、不動産の内見をVRで行うというサービスの理解をユーザーから得るのにはとても苦労したと話す。

しかし、ナーブ代表取締役の多田秀起氏は、不動産の内見をVRで行うというサービスの理解をユーザーから得るのにはとても苦労したと話す。