2020年に拡張現実感(AR)ヘッドセットを出荷する作業を進めていると噂されているAppleは、その作業を助けてくれるであろう、モントリオール(カナダ)のスタートアップを買収した。TechCrunchは、AppleがTotemヘッドセットのメーカーであるVrvanaを買収したことを知った。同ヘッドセットは様々なレビューでは話題になっていたものの、これまで出荷されてはいなかった。この取引額は約3000万ドルであったことを、2つの情報源がTechCrunchに明かしている。

私たちはAppleに連絡したが、同社はコメントを拒否した。しかしストーリーそのものは否定していない。Vrvanaは私たちからのコメント要求に答えていない。取引に近い情報源によって私たちは買収の事実を確認している。

AppleがARハードウェアに対して持つ興味に関する、報告や噂を見聞きしてきた私たちにとって、この取引は重要な意味を持つ。Appleは口が堅く、特に完全に新しい未来のプロダクトに対しては、一般にとても秘密主義だからだ。この買収は、おそらく同社が開発したいと考えているものを最も明白に示唆するものだ。

スタートアップの多くの従業員たちはカリフォルニアのAppleに加わった。Vrvanaのサイトは、現在まだ稼働しているが、今年の8月にはソーシャルアカウントとニュースの更新が中止されていた。

Vrvanaの既存製品、製品ロードマップ、または現在のビジネス(同社はNDAの下に、Valve、Tesla、Audiなどと協力していた)のうちの、どれがAppleに向かうのかは明らかではない。

Vrvanaがそのサイトで披露している唯一の製品は、未発売のTotemヘッドセットだ。これはARとVR(仮想現実感)の両方のキーテクノロジーを利用して、単一のヘッドセットで両者の体験を可能にする「拡大現実感」(extended reality)デバイスである。

VrvanaのTotemプロモーションビデオの1シーン

接続されたデバイスは、現在市場にある多くのVRヘッドセットと似通った大きさを持つ。しかしユニークな特徴として、複数の前方にパススルーカメラを備えていて、外部の世界をヘッドセット内部のOLEDディスプレイ上に映すことが可能だ。このヘッドセットのカメラシステムは、3D空間内でのデバイスの位置を把握する6DoF(six degrees of freedom)トラッキングを提供し、同時に赤外線カメラを用いてユーザーの手の位置を追跡することができる。

VrvanaのカメラベースのARアプローチは、Microsoftのような競合相手のアプローチとは異なっている。例えばMicrosoftの場合には、透明で投影可能なディスプレイをそのHoloLensヘッドセットに採用している。Totemはそうした競合システムに対して数多くの利点を持っている。最も素晴らしい点は、実世界上に完全に不透明で意図した色彩を持つアニメーションを表示することができるということだ。他のヘッドセットでは黒が投影できないために、映像は幽霊のような投影画像となる。このことによって、ヘッドセットは、VRとAR環境間の移行に際して、同社が「シームレスブレンド」と呼ぶ自然な移行を可能にする。

どうしても大型になってしまう外観はさておくとして、この種のシステムの主要な欠点は、外界をキャプチャするカメラとヘッドセット内に表示される速度との間にしばしば顕著な遅れが出てしまうことだ。VrvanaのCEOであるBertrand Nepveuは、この夏の談話でこの問題を詳述し、スタートアップはこの遅れを3ミリ秒にまで短縮したプロトタイプを作成していると語った。

TotemがいかにARモードとVRモードの間をスムースに移行できるかを示すアニメーション。

このような 「拡大現実感」テクノロジーのためのコンシューマアプリケーションがある。たとえば、ゲームやその他のエンターテインメントなどだ。しかしVrvanaが主に注力していたのは企業での利用だ。

「Totemのハンドドラッキングと、環境の中での位置トラッキングによって、従業員たちが仮想オブジェクトを何処ででも扱えるようになります」と、同社はヘッドセットの宣伝素材のなかで語っている。

これはAppleの関心――自分自身が、あるいは他のITプロバイダーたち、例えばIBM、Cisco、SAPなどと組んで、異なる企業のビジネスプロセスに入り込もうとする試み――から考えると注目に値するものだ。8月には、CEOであるティム・クックは、ARを使った野望の中心的な目標の一つとして、企業向け利用を選び出した。そして最新の業績では、Appleの企業向け用途への成長率が2桁を超えていることが公表されている。同社の企業向けセールスが伸び始めたのは2015年である、クックはそれを250億ドルのビジネスだと表現してみせた。

しかし、事業拡大はスタートアップ(特にハードウェアのスタートアップ)にとっては、最も難しいことの1つだ。これは特にまだ主流とはなっていない新興テクノロジーに取り組んでいるスタートアップにとっては更によく当て嵌まる。

2005年に創業したVrvanaは、その調達資金について多くを公開していない。情報源の1つは、TechCrunchに対して、このスタートアップは、ハードウェアの世界では控え目な200万ドル以下の調達を行っていると語った。PitchBookによれば、投資家に名を連ねているのは、Real Ventures(そのパートナーであるJean-Sebastian Cournoyerは、Montrealの野心的なAIスタートアップでありインキュベーターでもあるElement.aiに参加している)、Canadian Technology Accelerator、他のVRスタートアップでも活躍しているエンジェルのRichard Adler などだ。

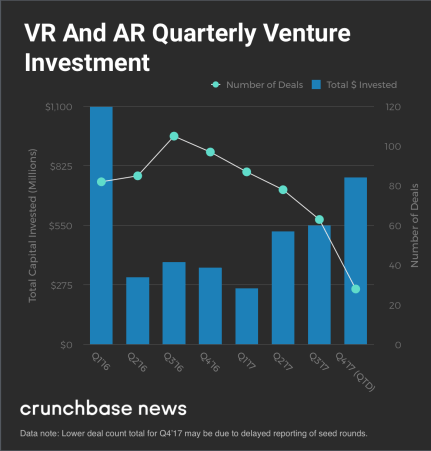

これまでのところ、Appleは今日の市場におけるVRとARハードウェアへの取り組み状況をかなり批判されていて、ゲームに対する取り組みも控え目なものである。

「現在のテクノロジー自身は、まだ十分なものではないと言わなければなりません。このディスプレイテクノロジーは、あなたの顔の周囲に十分なものも配置しなければなりませんが、これは大変な挑戦なのです」と、クックはヘッドセットを作っているのかという問に答えてThe Independentに対して語っている。「視界や、ディスプレイの品質そのもの、いずれもまだまだです…私たちは最初の体験がラットを使った実験のようになることを望んではいません、私たちは最高のものでありたいのです、そして人びとに素晴らしい体験を提供したいと思っています。しかし、この先すぐにマーケットに出てくるようなものは、どれも私たちを満足させてくれるようなものにはならないでしょう。それだけでなく、世の中の多くの人びとも満足させることはできないと思います。

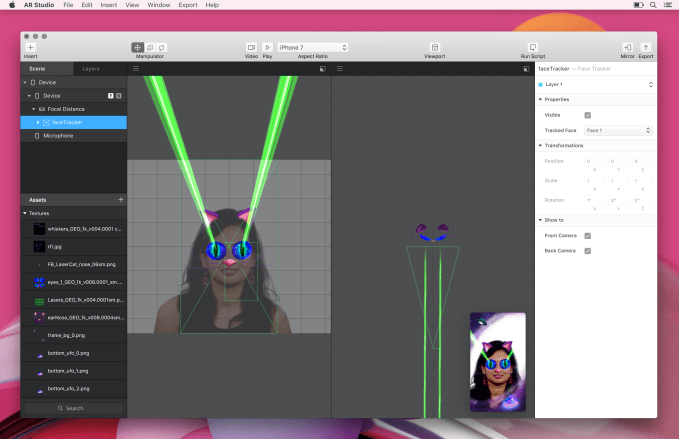

もちろんこれはAppleが拡張現実空間に熱中していないという意味ではない。しかしこれまでのところ、この関心は主に、専用のデバイスではなく、ソフトウェア(特に同社のiOSベースのARKit SDK)や、ますます洗練されたiPhoneのカメラアレイによって表現されてきている。とはいえAppleの所有する膨大な特許はそうした専用デバイスの存在を潜在的に示唆しているのだ。

Appleはまた、ハードウェアを強化する技術の開発に関心を持っていることを示す、他の買収も行っている。6月には、AppleはSMIを買収した、これはVRとARヘッドセットのための視線追跡ソリューションに取り組んでいる会社である。その他のARならびにVR関連の買収として含まれているのは以下のような企業だ、Flyby Media、metaio、Emotient、そしてFaceshiftである。

[原文へ]

(翻訳:Sako)