9to5macが紹介している最強のApple(アップル)預言者Ming-Chi Kuo(郭明錤氏)の最新記事によると、同社は拡張現実のヘッドセットを開発中であり、近くそのデバイスはローンチされる、ということだ。このメガネ型のデバイスは2019年第4四半期(10〜12月)から大量生産が始まり、2020年の前半には一部の地域で入手できるらしい。

この神秘のヘッドセットで何ができるのか、それはまだ未知数だ。郭氏によると、その機能はだいたいApple Watchと同じで、ARとしての計算処理はiPhoneが担当する。つまり、iPhoneがないと使えない。

そのグラスはiPhoneの外付けディスプレイのようなものとして、情報をユーザーの眼前に送り出す。インターネットへの接続や位置機能、コンピューティングなどヘビーな仕事はすべてiPhoneが担当する。ARヘッドセットとiPhoneの通信は、たぶんBluetoothを使うのだろう。

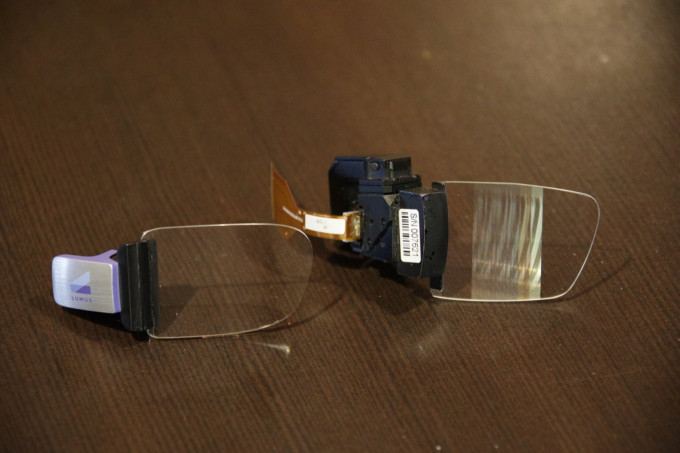

郭氏の記事にヘッドセットの詳細はない。ユーザーのまわりにあるものを表示したり感知しなければならないから、ディスプレイとセンサーはあるだろう。センサーで環境を感知しないARデバイスは、ありえない。

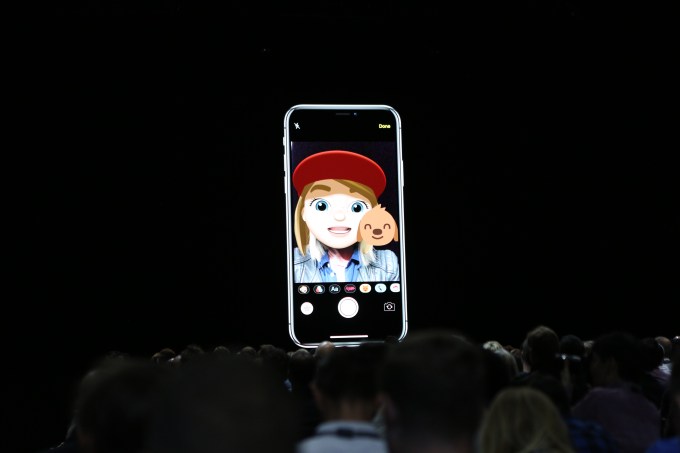

AppleはiOS上のARKitフレームワークですでに拡張現実の実験をしている。デベロッパーは、現実世界にデジタル成分を統合するアプリを、それで作ることができた。そしてその様子を、ヘッドセットでなく、スマートフォンのカメラで見るのだ。

そうやって多くのアプリがAR機能を加えたが、その多くは見掛け倒しで本物の価値はなかった。ARネイティブのアプリも、ほとんどない。

拡張現実の面白いユースケースのひとつが地図だ。Googleは最近、Google Mapsの拡張現実モードを発表した。スマートフォンを顔の前に構えると、矢印が出て行き先を教えてくれる。

Appleも、Apple Mapsを独自のデータで作り変えてきた(日本語関連記事)。地図を描くだけでなく、LiDARセンサーと8台のカメラを車の屋根に乗せて、現実世界のデータを大量に集めた。そのApple Mapsが、噂のARヘッドセットの重要な部分になるのか、そういう話なら面白い。