精密に制御されたストロボLEDライトと、細かく振動する動きを組みわせ、Slow Danceはリビングルームで「科学」を味わえるようにする。ハイテクと、身近な素材、そして人間の視覚的な特徴を組み合わせ、リアルタイムに「スローモーション」の動きを見ることのできるのだ。本プロダクトは現在Kickstarterキャンペーン中だ。

仕掛けとして用いているストロボスコープ(一瞬だけ点灯する光源を繰り返し発光させる仕組み)は、科学博物館やアートギャラリーなどでよく目にするものだ。見ていて面白く、個人的にはこれがより広く、家庭用に普及しないのを不思議に思っていた。それを変えようとするのがSlow Danceだ。

科学、アート、テクノロジーを組み合わせて、そして不思議な世界を実現している。美しく、見ていて飽きないプロダクトだ。

光と科学の組み合わせ

「人間の知覚の限界を超えたところで何が起こっているのか、というようなことに興味を持っていました」とMITで4つの学位を得た、Slow Dance開発者のひとりであるJeff Liebermanは言っている。Liebermanはこれまでにもストロボスコープとスプリングを組み合わせて異次元世界のような視覚効果を映しだしたSlink(2005)や空中に浮かんでついたり消えたりする不思議な電球を映すLightbulb(2007)などの映像作品をYouTubeに公開している。ディスカバリーチャンネルでも「タイムワープ 瞬間の世界」をホストしていたのをご記憶の方も多いだろう。番組ではハイスピード撮影の世界に見える不思議を紹介していた。

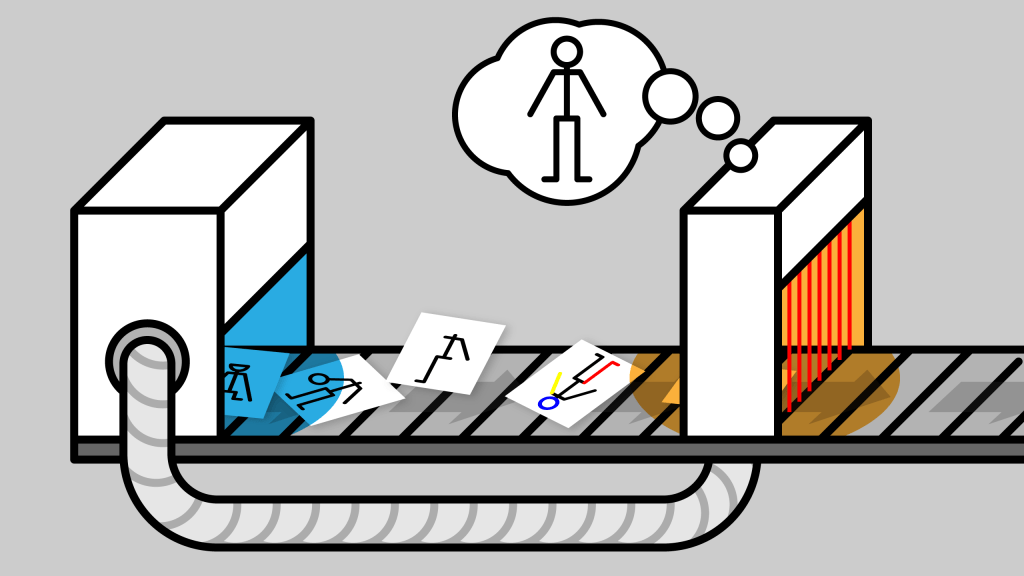

電磁石を利用して振動を与える。

プロダクトとしては、額縁の内側に素早く点滅するLEDを組み込んでいる。LEDは1秒に80回の点滅を行い、これは人間には知覚できないほどの速さだ。ライトが点滅していることに気づきもしないことだろう。

その光の中で高速に振動する物体を配置することにより、まるで物体がスローモーションで動いているように見えるのだ。

テレビ画面でなら見慣れたものだが、それを目の前で見ることができるというわけだ。これはかなり面白い。

これは、映画がまるでふつうに動いているかのように見えるのと同じ原理だ。映画はフレームを高速に流していくことで、動きが連続しているかのように錯覚させるものだ。

Slow Danceでは額縁内で高速にLEDを点滅させ、そして物体を細かく振動させることにより、まるでスローモーションを見ているように、脳に錯覚させるのだ。

光と動きのマリアージュ

「友人のダンサー2人が結婚することになったときに、何かダンスに関わるようなものをプレゼントしたいと考えたのです。それから試行錯誤を繰り返し、そしてSlow Danceが生まれたのです」とLiebermanは言っている。最初は金属でできた物体を振動させていたが、2人を表現するのに、もう少しオーガニックなものの方が良いと考えなおしたのだそうだ。「研究室の行き来のときにもいろいろと考え続けました。そして身近にある自然をスローモーションで眺める魅力を発見したのです」。

スローモーション風に動かす物体は、Slow Danceに装着されたゴムバンドで固定するようになっている。つまり、額縁サイズに収まるなら、使う物体はひとつでなくても良いのだ。もちろん振動するものであることが必要で、たとえば羽や植物などが使いやすい。

Slow Danceは開始されたばかりのKickstarterプロジェクトだが、既にゴールの7万ドルは突破している。技術的にはシンプルなものだが、精度を必要とするプロダクトだといえるだろう。Liebermanは量産化も問題なく行えるとしている。実はLiebermanは以前にもKickstarterキャンペーンを立ち上げていて、その際も目標額を達成して、無事プロダクトの出荷を行なっている。今回はMakey Makeyの出荷を担当したEtonnetとも協力して迅速な対応を心がけているそうだ。

「これが初めてではないんです」とLievermanは述べる。「予定通りにことが進めば、1月には出荷できるようになると考えています。遅くとも3月にはお手元に届くでしょう。以前のKickstarterプロジェクトの経験から、起こりうるトラブルもある程度は織り込み済みです。前回の経験に学びつつ、新たに出てくるかもしれない問題にも迅速に対応していきたいと思っています」。

ちなみに、このプロジェクトで一番難しかったのは、プロダクトを組み立てることではなかったとのこと。ストロボスコープによる映像をビデオで見せるのが最も大変だったとのことだ。

「誰でもスローモーションの映像は見たことがあります」とLiebermanは笑いながら話してくれた。「ビデオ化すると、ひとびとはふつうのものをスローモーションで映しているだけだと考えてしまうでしょう。ビデオをスローにしているのではなく、目の前の物体がスローモーションに見えているのだと説明するやり方に、いろいろと試行錯誤しました」。

Slow DanceのKickstarterプロジェクトはこちらで行われている。早割価格はすべて終了してしまっているが、229ドルのものが若干残っている。配送地域は「Anywhere in the world」となっている。

[原文へ]

(翻訳:Maeda, H)