ドイツの司法大臣はFacebookの個人情報流出問題に関して、サードパーティデベロッパーや他の外部プロバイダーがFacebookの情報を誤った形で使用することができないよう、内部統制と罰則を盛り込んだプラットフォームを要求する書簡をFacebookに送った。サードパーティがプラットフォームポリシーを遵守し、ルール違反した場合には厳しい罰則を課すことを求めている。

地元メディアに全内容が掲載されたこの手紙は、ロンドンのオブザーバー紙とNYタイムズが3月中旬にスクープして以来、Facebookが集中砲火を浴びている個人情報流出問題をさらに追求するものだ。このスクープ報道は、Cambridge AnalyticaがFacebookユーザー8700万人の個人情報をどうやって入手して選挙で不正利用したか、詳細を白日の下にさらした。

Facebook創業者でCEOのマーク・ザッカーバーグに宛てた書簡で、カタリーナ・バーレー司法大臣は、ユーザーのプライバシーに関してFacebookが最近とった対策について、“データディーラー”との協業を制限するのは“いいスタート”と評するなど歓迎の意を表明した。

しかし、バーレー司法大臣はFacebookにさらなる対応を求めている。データと利用者の保護という観点で一連の“必要不可欠な措置”をとるべき、というものだ。

大臣はまた、ドイツそして欧州におけるデータと消費者保護という点で、今回のCambridge Analyticaスキャンダルに伴いFacebookは長期の批判にさらされることになるとしている。加えて、Facebookの情報の扱いについてさまざまな告訴がなされたことも示唆している。

「遺憾ではあるが、Facebookはこれまで批判に対し十分に対応してこなかった」(Google Translateによる翻訳)。さらに「Facebookはデータ収集とデータの使用を拡大させ続けてきた。これは、プライバシー、そしてユーザーやサードパーティの自己決定を犠牲にしているものだ」と記している。

そして「必要なのは、Facebookが企業責任を果たし、抜本的に見直すことだ」と手紙を結んでいる。「(ザッカーバーグ氏は)インタビューや広告の中で、EUの新たな情報保護法はソーシャルネットワークにとって世界のスタンダードだ、と述べている。残念なことに、こうした考えをFacebookが履行しているかははなはだ疑問だ」と批判。さらに、EUの法律が適用されることがないよう、15億人にものぼる世界のユーザーのデータ操作ステータスを変更するとしたFacebookの決断についても懸念を示し、「だからこそ今後もFacebookが行うことを注視していく」と述べている。

Cambridge AnalyticaがFacebookの個人情報を使用していたという暴露が、Facebookにとって世界的なプライバシー問題へと発展して以来、同社はプラットフォーム上でのデータ保護を実行するためいくつかの見直しを明らかにした。

しかし、実際のところ、Facebookが発表したこの見直しのほとんどは、5月25日に施行されるEU一般データ保護規則(GDPR)への対応として少なくとも数カ月も前から準備が進められていたものだった。

にもかかわらず、Facebookの打ち出した策はプライバシー問題の専門家から手厳しく批判されている。GDPRに十分に対応しているものではなく、GDPRが適用されれば法的な問題とを引き起こす、とみている。

例えば、Facebookが先月発表した新たな同意の流れというのは、意図的な操作とみなされ、少なくとも新ルールの精神に反するものだと批判されている。

バーレー大臣はこうした批判を手紙の中で取り上げ、Facebookに下記の点を実行するよう、具体的に求めている。

・ユーザーにとっての透明性を高める

・ユーザーデータの取り扱いでの真のコントロール

・当然あるべきプライバシーと、Facebookのエコシステムへの同意についての厳密なコンプライアンス

・客観的、中立的、そして排他的でなく、ごまかしもないアルゴリズム

・設定や使用についてのユーザーの自由な選択

同意については、大臣はGDPR下では、Facebookはデータ使用ごとにユーザーの同意を得る必要があることを強調している。一括同意ですべての点で同意を得た、というふうにはできないというものだ。

これは、明らかにFacebookがいまやろうとしていることだ。例えば、欧州のユーザーに顔認証を選択するかどうかをたずねるとき、これによりユーザーの写真を外部の人が勝手に使用するのを防ぐことができるかもしれない、また、視覚障害を抱える人にとって助けとなるかもしれないと案内している。しかし、Facebookが必ず行う商業利用への同意の中には具体的な例は示されていない。

大臣はまた、GDPRではプライバシーをデフォルテ設定し、データの収集を最低限に抑えることが要求されると強調。GDPRに従うには、全てのデータ処理を見直す必要があるという主張だ。

“友達”からのデータ移送は、それぞれのケースで明白な同意の元行われるべきだ、とも述べている(2014年にデベロッパーがFacebookのプラットフォーム上でユーザー8700万人分のデータを収集してCambridge Analyticaに情報を流していたとき、同意は欠落していた)。

さらに、バーレー大臣ははっきりとFacebookに対し、シャドウプロファイルを作るべきではないと警告している。このシャドウプロファイル問題は先月、米議会がザッカーバーグ氏を呼んでただすなど、法的問題となっている。

Facebookは自社の開発者会議f8で、これまで同社が収集していたユーザーのブラウズ履歴を削除できるボタンを導入すると発表した。しかしこれは単に矛盾を強調するだけのものだ。Facebookによって追跡されている非ユーザーはこの削除ボタンを利用できないし、そもそも追跡などしないでくれとFacebookに言うこともできないからだ。

Facebookが、この非ユーザーのデータから発生した情報をどう扱っているのか明らかでもない。

確かに、このブラウズ履歴削除ボタンをクリックすることで、ユーザーは閲覧したサイトの履歴を消去することはできるだろう。しかしそれは、データから収集されたものを全て消去する、ということにはならない(おそらく見えないプロファイルに追加され、広告戦略目的に使用される)。

履歴削除のボタンは、FacebooknのPRにすぎない、と言ってもいいだろう。「ユーザーにしかるべき操作機能を提供している」と言えるようにする。これは、議員の追及をかわす戦略の一つなのだ(先月の米国議会でのやり取りは全く誠実さに欠けるもので、英国議会でもおおっぴらに批判された)。

TechCrunchでも、この履歴削除がどのように働くのか、なぜ導入するのかといった質問をFacebookに送っている。なぜなら、このボタンはデータ追跡を完全にブロックする機能を持っていないからだ。2日間にわたりこうした内容の電子メールを送っているが、Facebookからまだ一切返事はない。

主なWebサービスで使われているトラッキングピクセルやソーシャルプラグインを通じて集められた非ユーザーのデータの扱いをEUの規則に照らすと、Facebookはすでに苦境に陥っている。GDPRが施行されると、同意なくデータを利用するのは、そのアプローチを大幅に見直さない限り、明らかに大きな問題となる。

バーレー大臣は手紙の中で、政治的影響や意見操作を目的とする誤ったFacebookプラットフォームの使い方についても懸念を示している。そうした乱用や巧妙な操作の可能性を排除するため(例えばフェイクアカウントやソーシャルボットなど)、テクニカル面そして組織的面においてあらゆる方策をとる必要があると指摘する。その際は、客観的で中立的、そして排他的でないアルゴリズムを確保するよう述べている。

大臣はまた、独立したレビューを可能にするためにも対策をすべて開示するようFacebookに求めている。

Facebookは巨大だ。WhatsAppやInstagramといった人気のプラットフォームを傘下に抱え、効率的に収益を上げるエコシステムを急速に拡張してオフサイト追跡を展開している。バーレー大臣に言わせると、このエコシステムはドイツ、そして欧州のユーザーのプライバシーや自己決定権を犠牲にしているものとなる。

Facebookは大臣の手紙に対するコメントを複数から求められているが、この記事の執筆時点では応じていない。

[原文へ]

(翻訳:Mizoguchi)

人材分析サービス「

人材分析サービス「

のマーケティング・ホリデーに因んで、May the Fourth

のマーケティング・ホリデーに因んで、May the Fourth

と

と の代わりに)Tic Tac Toeをコップのセットでプレイすることは、上肢のリハビリに役立つゲームの例の1つです」と語るのはShelly Levy-Tzedek博士だ。「沢山のコップを持ち上げたり置いたりすることで、ゲームを楽しみながら日常タスクのパフォーマンスを向上させて行くことが可能です」。

の代わりに)Tic Tac Toeをコップのセットでプレイすることは、上肢のリハビリに役立つゲームの例の1つです」と語るのはShelly Levy-Tzedek博士だ。「沢山のコップを持ち上げたり置いたりすることで、ゲームを楽しみながら日常タスクのパフォーマンスを向上させて行くことが可能です」。

「これは、夏の間にタイヤショップで働いたこと以外で、私がやったことのある、唯一の職業なのです」と彼は

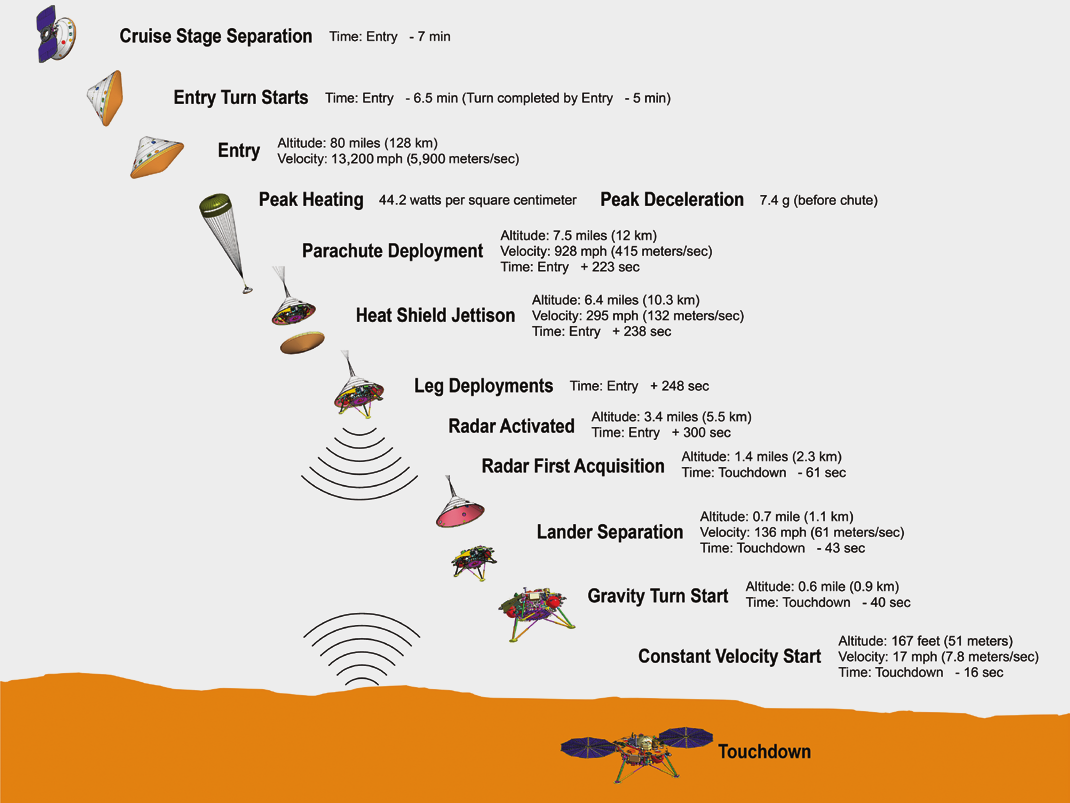

「これは、夏の間にタイヤショップで働いたこと以外で、私がやったことのある、唯一の職業なのです」と彼は まずSEISは、小さな野球ドームのような外見の、地表に置かれる6台の地震センサーの集まりで、足元の地表の微かな振動に至るまでモニターを行う。微小な高周波振動や長周期振動も、すべて検知されることになる。

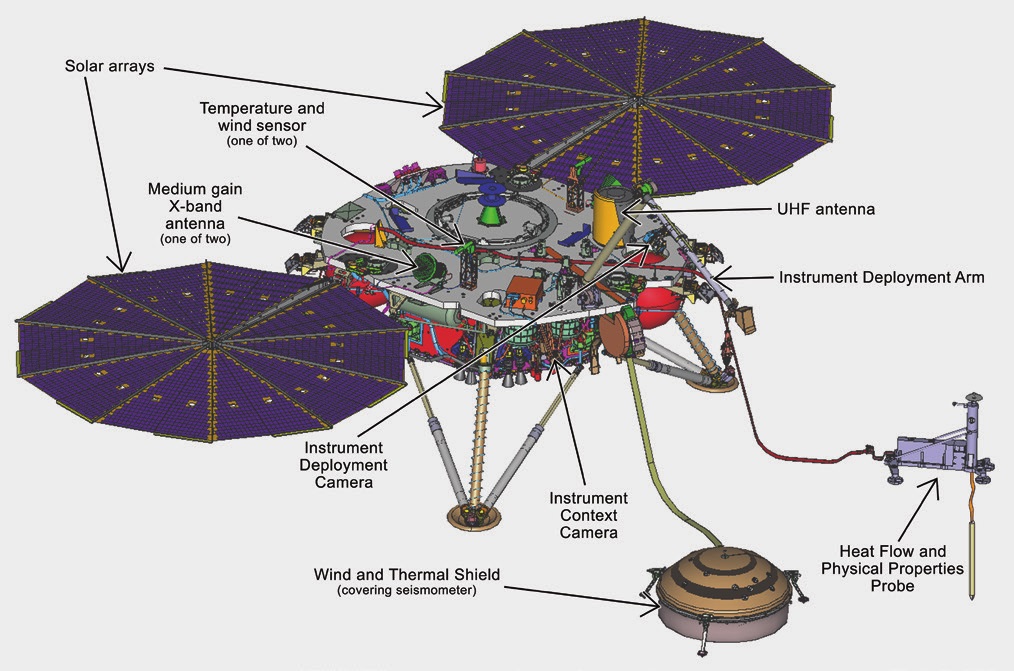

まずSEISは、小さな野球ドームのような外見の、地表に置かれる6台の地震センサーの集まりで、足元の地表の微かな振動に至るまでモニターを行う。微小な高周波振動や長周期振動も、すべて検知されることになる。 またInSightに備えられたロボットアームは、単に岩石を掴み上げて観察するだけでなく、その格納庫からものを取り出して作業場所に置く役割も果たす。そのアームの先の小さな指は、設置する各機器の上にあるハンドルを、人間のように掴むことができる。まあ、正確には多少やり方は違うかもしれないが、原則は同じだ。約244センチの長さであり、平均的な宇宙飛行士よりも遠い場所に手が届く。

またInSightに備えられたロボットアームは、単に岩石を掴み上げて観察するだけでなく、その格納庫からものを取り出して作業場所に置く役割も果たす。そのアームの先の小さな指は、設置する各機器の上にあるハンドルを、人間のように掴むことができる。まあ、正確には多少やり方は違うかもしれないが、原則は同じだ。約244センチの長さであり、平均的な宇宙飛行士よりも遠い場所に手が届く。

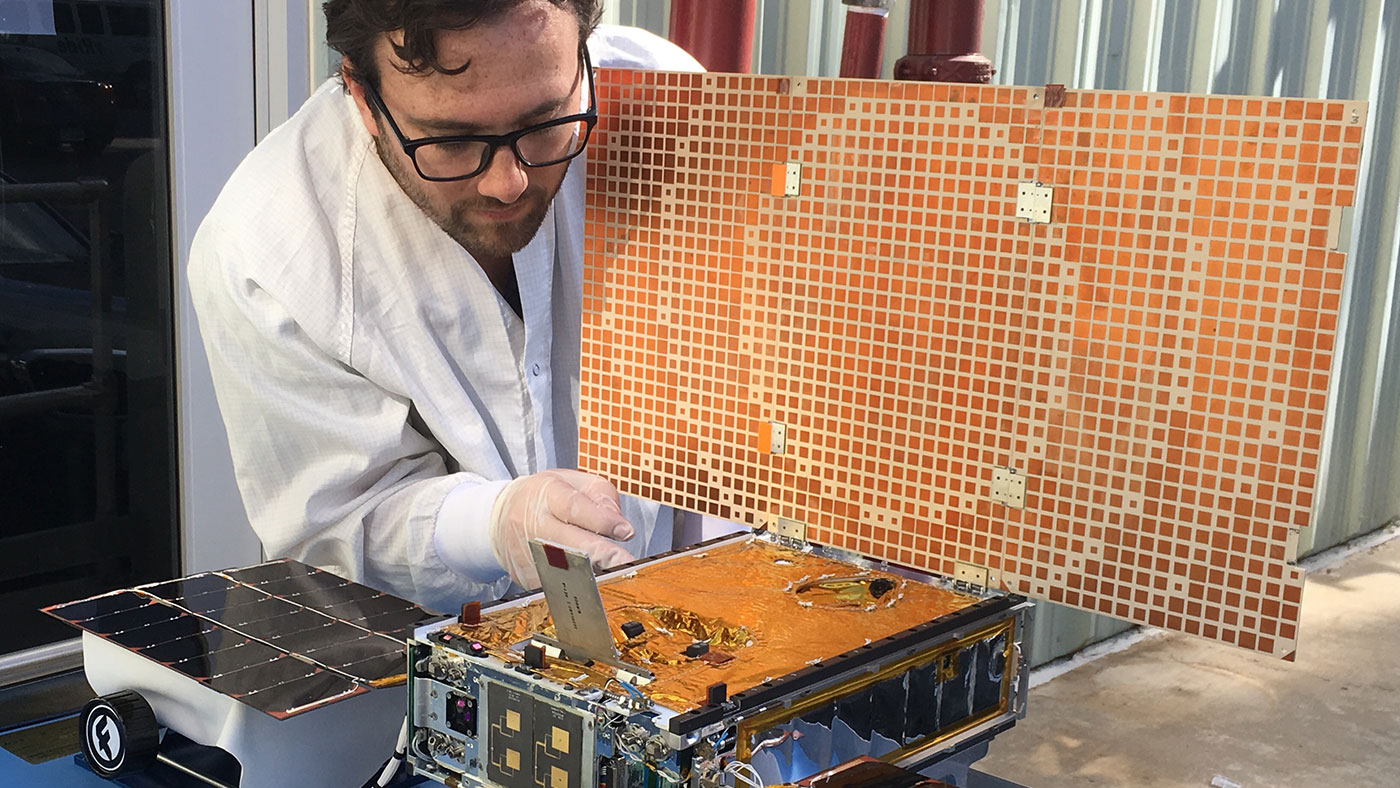

今回は特に超重要な実験は想定されていない。1つが故障することに備えて2つ用意されていて、どちらもデータを送受信するUHFアンテナと、何台かの可視光低解像度カメラを搭載しているだけだ。実際ここで行われる実験が対象にしているのは、CubeSat自身と、その打ち出し技術である。彼らが火星の軌道に乗れば、InSightの信号を地球に送る手助けをしてくれるかもしれない。もし彼らがそれ以上の働きを見せてくれたとしたら、それはあくまでもボーナスというものだ。

今回は特に超重要な実験は想定されていない。1つが故障することに備えて2つ用意されていて、どちらもデータを送受信するUHFアンテナと、何台かの可視光低解像度カメラを搭載しているだけだ。実際ここで行われる実験が対象にしているのは、CubeSat自身と、その打ち出し技術である。彼らが火星の軌道に乗れば、InSightの信号を地球に送る手助けをしてくれるかもしれない。もし彼らがそれ以上の働きを見せてくれたとしたら、それはあくまでもボーナスというものだ。