今日までのアプリやサービスには標準のアクセシビリティがなく、通常のスマートフォンやマウス、キーボードなどを使えない人たちのための良質な代替手段がないことが多い。視標追跡(eye-tracking)技術のリーダーであるTobiiは、一連の人気アプリを視線でコントロールできる方法を発明した。

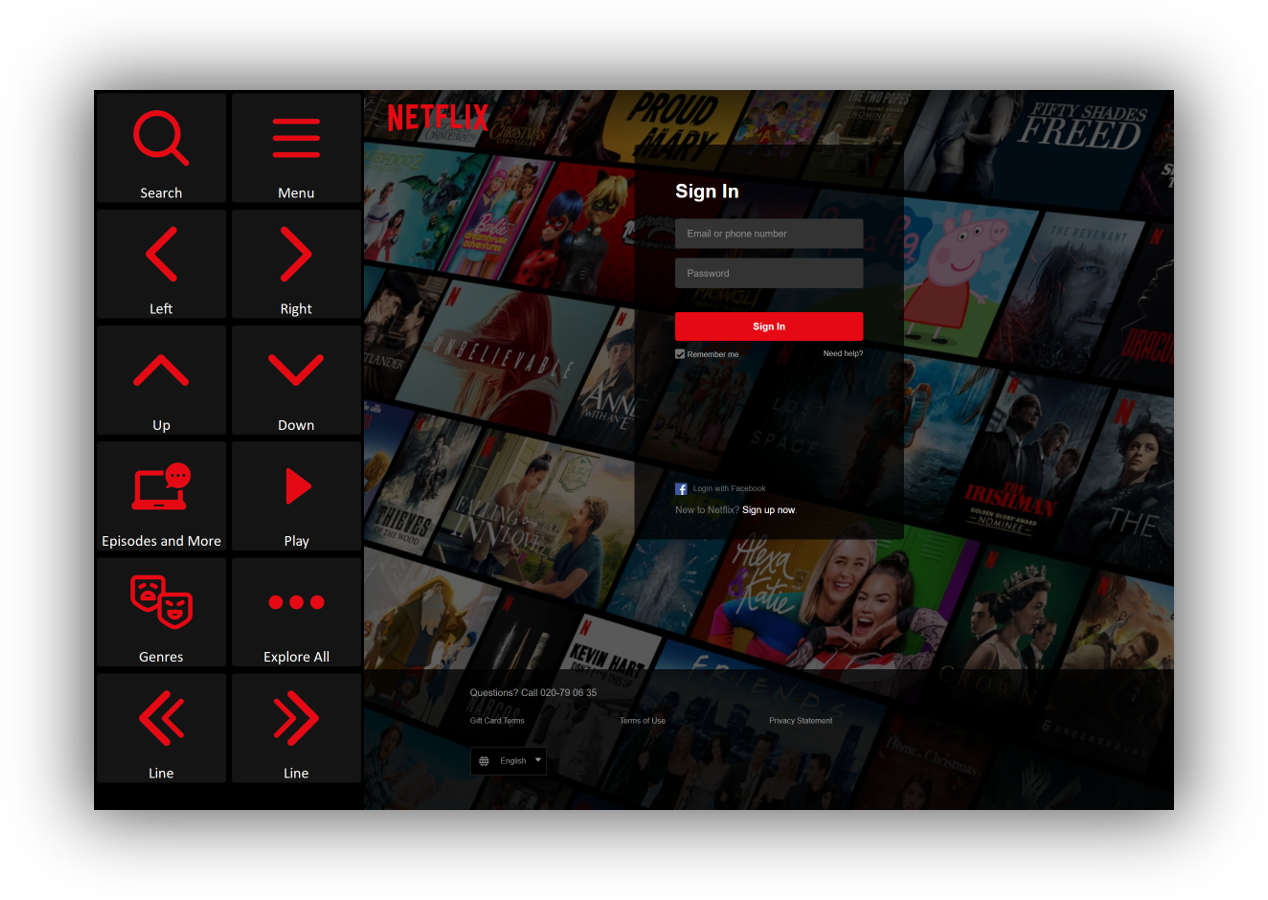

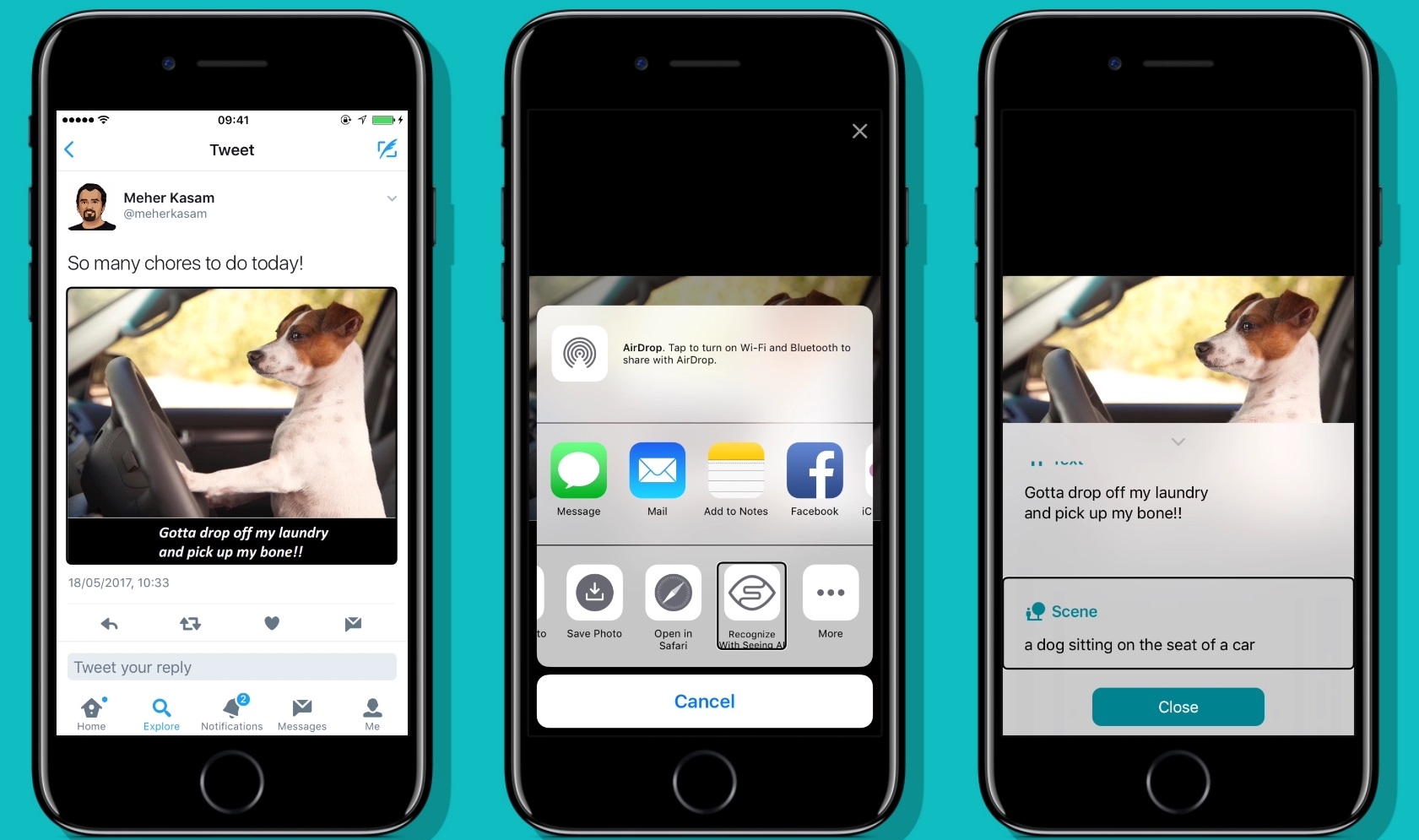

アクセシビリティの専門家であるサードパーティのデベロッパーと協力して同社がこれまでに作り上げたアプリはFacebook(フェイスブック)、FB Messenger、WhatsApp、Instagram、Google(グーグル)、Google Calendar、Google Translate、Netflix(ネットフリックス)、Spotify、YouTube、MSN、そしてAndroid Messagesだ。

これらのカスタムアプリは、Tobiiの視標追跡タブレットであるI-Series、またはTobiiのハードウェアとソフトウェアを使用するWindows PC用だ。

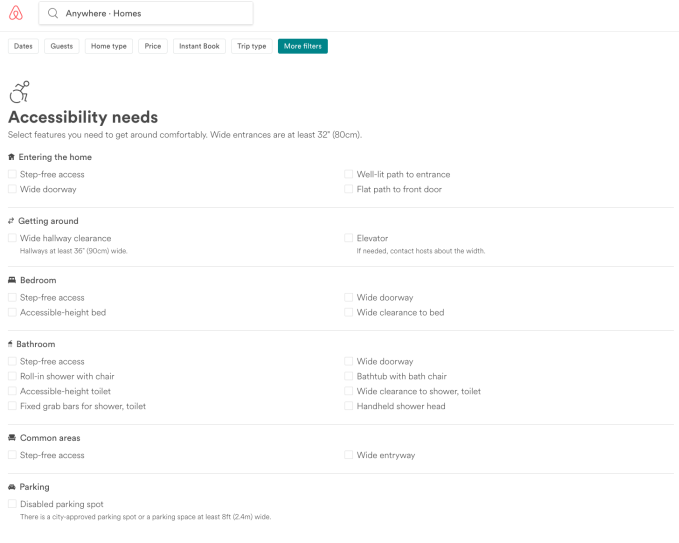

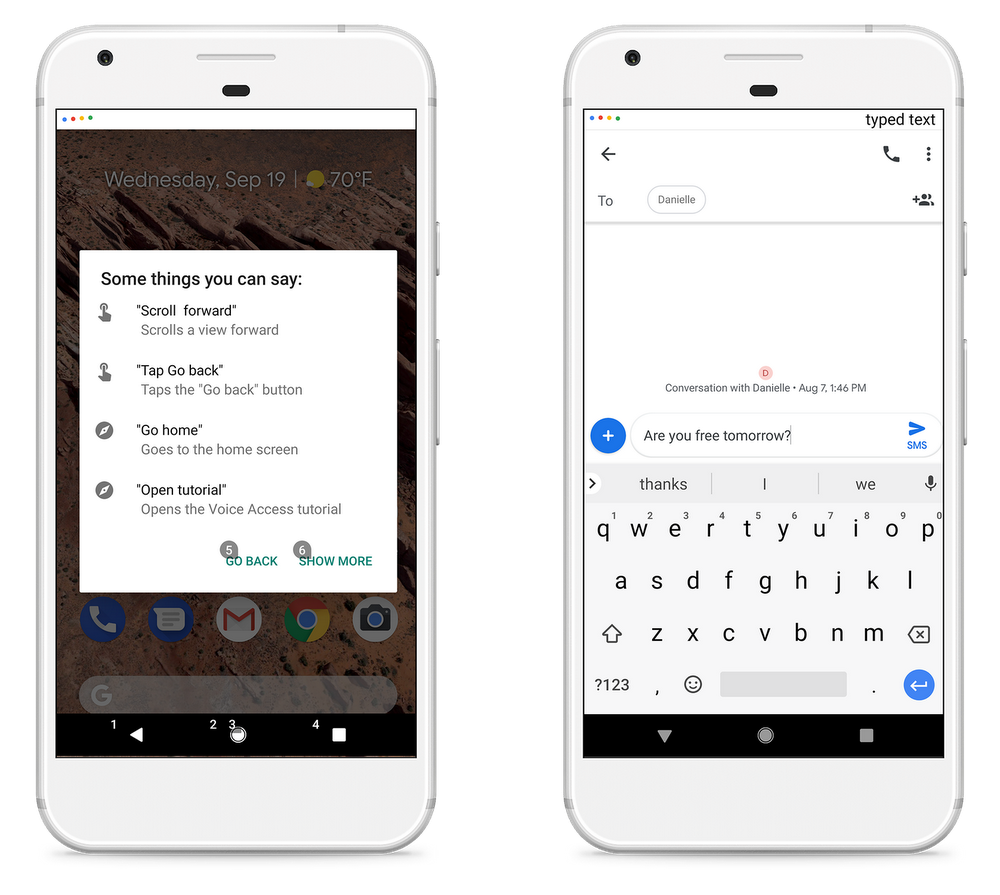

しかしこれまでのユーザーは、これらのサービスのための一般的なウェブインターフェイスを使うか、ネイティブアプリになんらかのレイヤーを追加する必要があった。しかしボタンやメニューなどは視標追跡向けに設計されておらず、小さすぎて操作しづらかったりことも多かった。

ニューバージョンもウェブアプリがベースだが、視標追跡を念頭に置いて設計されているため、大きくわかりやすいコントロールが用意されており、アプリの通常のインターフェイスが右側にある。シンプルな方向を示すコントロールはもちろん、コンテキストやアプリ固有の指定ができるコントロールもある。例えばネットフリックスを閲覧するときは「ジャンル」を使うことができる。

同社は上記写真に写っている1人のユーザーであるDelaina Parrish(デライナ・パリッシュ )に紹介している。彼女はInstagramなどアプリを使ってFearless Independence(怖くない自立)というブランドを立ち上げているが、脳性小児麻痺のため十分にアプリを使いこなせないことがある。彼女はTobiiのプレスリリースで「これらのアプリにアクセスできるようになり、毎日の生産性とコミュニケーションのチャネルが、プライベートと仕事の両方で改善され、多くのことを自分でできるようになりました」と語っている。

障碍者が使える「十分に良い」ツールやインターフェイスと、アクセシビリティを最初から目標として作られたものとの違いを課題評価することは難しい。新しいアプリは、互換性のあるデバイスなら今すぐ利用できる。

画像クレジット: Tobii

[原文へ]

(翻訳:iwatani、a.k.a. hiwa)

XACは最近のイベントで正式公開されたが、数日前にリークもされていた。デバイスは2つの巨大なプログラマブルボタンと大型の十字ボタンからなっている。後部の3.5 mmポートには、ブローチューブ、ペダル、Microsoft製のアクセサリーなど実に様々な種類のデバイスを接続できる。

XACは最近のイベントで正式公開されたが、数日前にリークもされていた。デバイスは2つの巨大なプログラマブルボタンと大型の十字ボタンからなっている。後部の3.5 mmポートには、ブローチューブ、ペダル、Microsoft製のアクセサリーなど実に様々な種類のデバイスを接続できる。

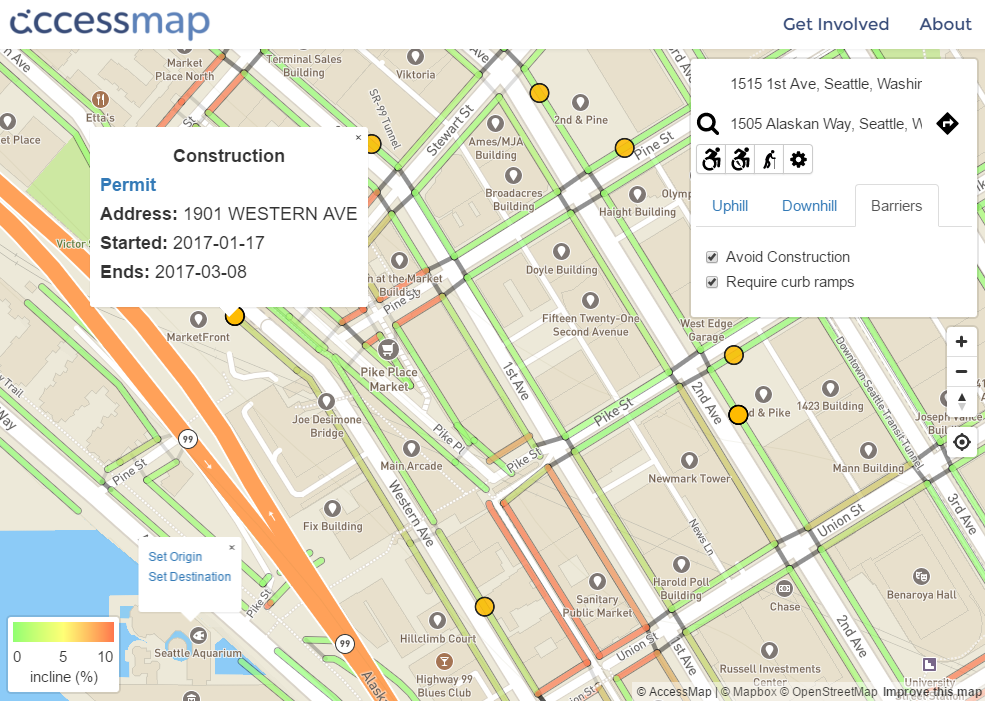

これは、障害者やベビーカーを使っているひと、あるいは重い荷物を持ち歩くひとたちが、便利になることは間違いない。

これは、障害者やベビーカーを使っているひと、あるいは重い荷物を持ち歩くひとたちが、便利になることは間違いない。 作るのが可能であることはわかっている。何人もの学生が

作るのが可能であることはわかっている。何人もの学生が